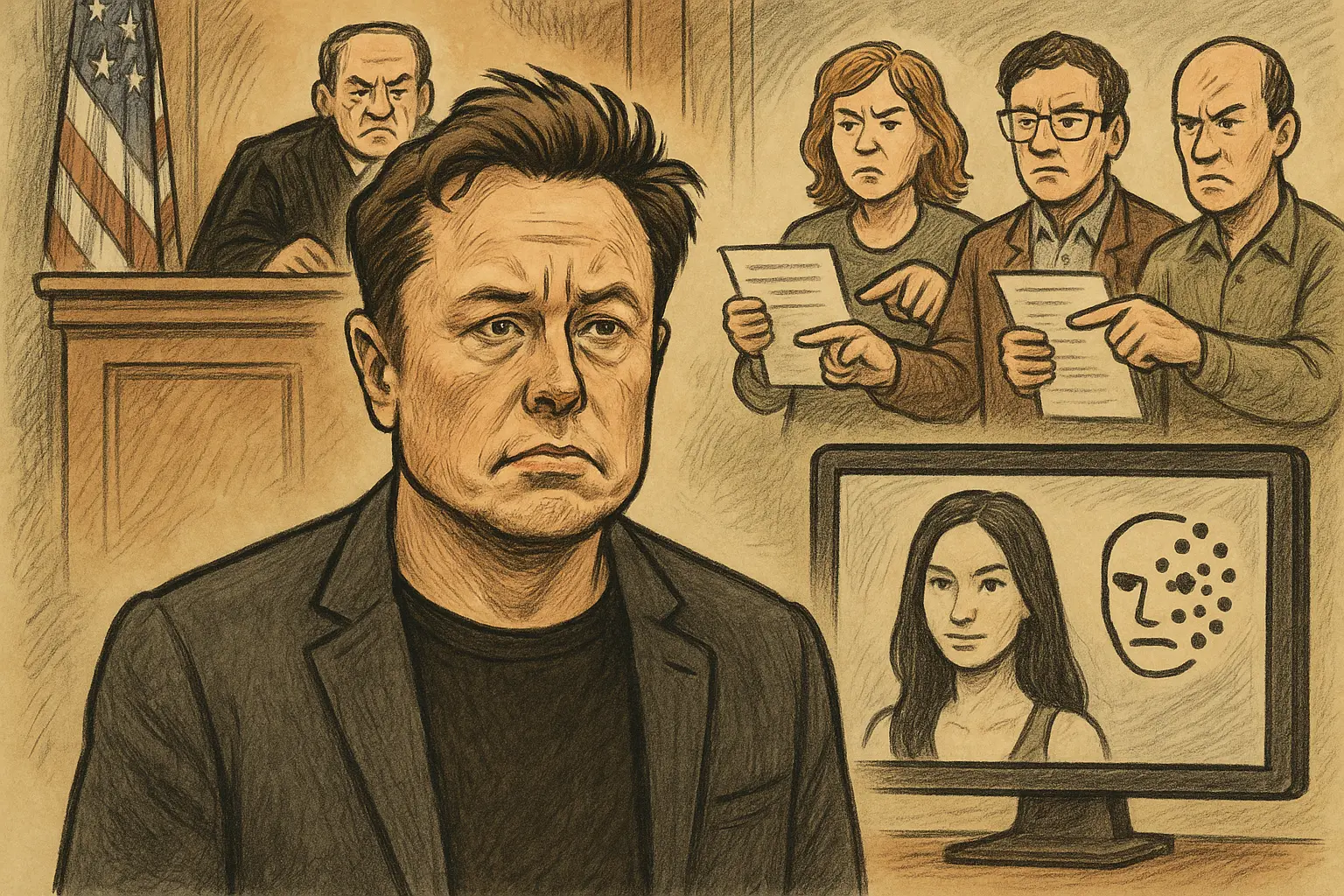

Demanda colectiva contra xAI de Musk: Grok genera una imagen deepfake cada 41 segundos

Tres mujeres menores de edad de Tennessee presentaron una demanda colectiva el lunes en la Corte Federal del Distrito Norte de California contra la compañía xAI de Elon Musk, acusándola de que su chatbot Grok AI utilizó sus fotos reales para generar material de abuso sexual infantil (CSAM) y lo difundió ampliamente en comunidades como Discord, Telegram y plataformas de compartición de archivos, causando daños psicológicos duraderos y daños a su reputación.

Núcleo de la demanda: intereses comerciales prioritarios sobre la seguridad infantil

Según la demanda, las principales reclamaciones de los demandantes abarcan varios aspectos:

Permisividad consciente: La demanda afirma que xAI, al lanzar Grok, sabía que su función de generación de imágenes podía ser utilizada para crear contenido ilegal que involucra a menores, pero no tomó medidas de seguridad estándar de la industria, constituyendo una decisión deliberada y no una negligencia.

Mecanismo de elusión de responsabilidad por terceros: Los delincuentes accedieron a Grok a través de aplicaciones autorizadas por xAI. La demanda acusa que xAI aprovechó intencionadamente esta estructura, obteniendo beneficios del modelo subyacente mientras establecía una capa de protección legal para sí misma.

Declaraciones públicas de Musk: En enero de este año, Musk escribió en X que “no tiene ninguna imagen de menores desnudos” y afirmó que “al solicitar la generación de imágenes, rechazará cualquier contenido ilegal”. Los datos en la demanda contradicen directamente esta afirmación.

Alcance de la compensación: Se afirma que las víctimas buscan al menos 150,000 dólares por cada infracción bajo la Ley Martha, además de recuperar ganancias ilícitas, daños punitivos, honorarios legales y una orden de restricción permanente, y exigen la devolución de beneficios según la Ley de Competencia Desleal de California.

Datos del Centro para Contrarrestar el Odio Digital: una imagen cada 41 segundos

La demanda cita datos del Centro para Contrarrestar el Odio Digital para respaldar cuantitativamente las acusaciones:

Periodo: del 29 de diciembre de 2025 al 9 de enero de 2026 (aproximadamente 11 días)

Cantidad de imágenes: Grok generó aproximadamente 23,338 imágenes sexualizadas de menores en ese período

Velocidad de generación: en promedio, una imagen cada 41 segundos

Difusión: el contenido se distribuyó en varias plataformas formando comunidades de intercambio anónimas, y al menos una víctima fue informada por un denunciante anónimo de que su imagen estaba siendo traficada.

Regulación global: investigaciones en seis jurisdicciones

Este caso no es aislado, sino parte de una revisión sistemática global sobre la seguridad de las imágenes generadas por Grok AI:

Australia: La comisionada independiente de seguridad electrónica, Julie Inman Grant, advirtió que los problemas de generación no consensuada de imágenes de menores están en aumento, con un incremento en las quejas en los últimos meses, algunas relacionadas con potenciales materiales de explotación sexual infantil.

Irlanda: La Comisión de Protección de Datos (DPC) inició una investigación formal sobre X Internet Unlimited Company (XIUC), responsable de las operaciones de X en la Unión Europea, bajo la ley de protección de datos irlandesa.

Estados Unidos, Unión Europea, Reino Unido, Francia: Se están llevando a cabo investigaciones simultáneas, formando una presión regulatoria sin precedentes en múltiples jurisdicciones.

Preguntas frecuentes

¿Cómo chocarán esta demanda colectiva y la posible defensa de xAI basada en la “exención de responsabilidad de plataformas”?

Alex Chandra, socio de la Alianza Legal IGNOS, indica que es probable que los tribunales no acepten una defensa simple de plataforma. Señala que los sistemas de IA generativa, en su interacción con usuarios, pueden considerarse plataformas, pero en términos de evaluación de seguridad deben tratarse como productos. En casos relacionados con CSAM, debido a la obligación de protección infantil, se aplicarán estándares de revisión “especialmente estrictos”. Las empresas podrían necesitar presentar evaluaciones de riesgos y medidas de seguridad antes del despliegue para demostrar el cumplimiento de sus obligaciones proactivas.

¿Qué es la Ley Martha y por qué es relevante en este caso?

La Ley Martha es una legislación federal de EE. UU. dirigida específicamente a materiales de abuso sexual infantil, estableciendo responsabilidades civiles y penales estrictas para la creación, distribución y posesión de CSAM, con multas mínimas de 150,000 dólares por infracción. La cuestión central en esta demanda es si xAI puede ser considerada “creadora” de CSAM y si su estructura de autorización a terceros puede eximirla de responsabilidad directa. La clarificación de estos límites legales podría tener un impacto profundo en la responsabilidad en toda la industria de contenido generado por IA.

¿Qué impacto podría tener este caso en el desarrollo futuro de la tecnología de generación de imágenes por IA?

Este es uno de los primeros casos en los que se busca responsabilizar directamente a una compañía de IA por la generación de CSAM que involucra menores. Si los tribunales concluyen que las empresas de IA son responsables por el uso abusivo de sus modelos, esto obligará a la industria a elevar significativamente los estándares de seguridad previos al despliegue, incluyendo pruebas de red team, mecanismos de filtrado de contenido y restricciones predefinidas en capacidades de generación de alto riesgo. Esto podría transformar radicalmente los procesos de revisión y regulación en la comercialización de modelos de IA generativa.