ベースラインカーブからR&Dクローズドループへ:2028年以前に「AIリカーシブ・セルフインプルーブメント」が実現する確率を客観的に評価する

なぜ「60%の確率」が真剣に検討されるべきか

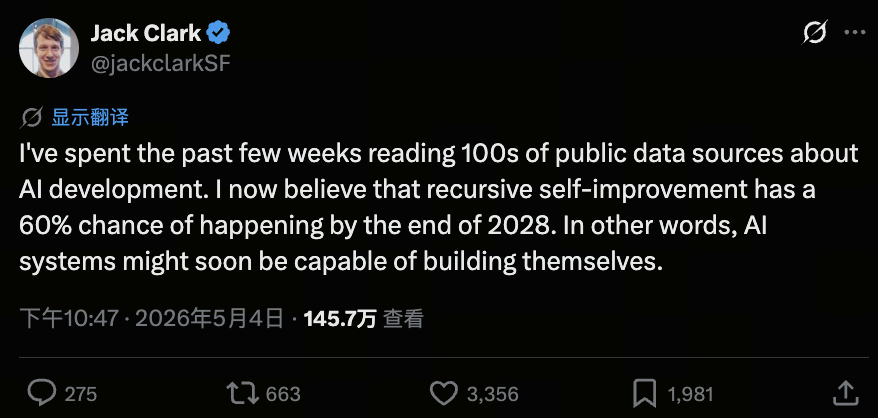

画像出典:Anthropic Co-Founder Tweet

画像出典:Anthropic Co-Founder Tweet

AIに関する議論では、結論ばかりが注目され、その根拠が見落とされがちです。特に再帰的自己改善(RSI)に関する議論ではこの傾向が顕著です。一見すると、議論の中心は「2028年までにAIが自己強化型のR&D能力を獲得する可能性が高い」という大胆な主張です。しかし本質的な問題は、このシナリオを周縁的な仮説から、主流の意思決定者が取り組むべき主要リスクセットへと移行させるだけの「体系的な初期シグナル」が十分に観測されているかどうかにあります。

この問いは政策・産業双方にとって重要です。RSIは単なる抽象的な「汎用知能神話」ではなく、エンジニアリング上の課題だからです。つまり、AIがR&Dワークフローの中で高付加価値なステップを増やし、それらを継続的かつ反復的なクローズドループとしてつなげられるかが問われています。このループが確立されれば、技術進歩の速度が変化し、組織の能力格差が再定義され、従来の規制サイクルが撹乱されます。

したがって、RSIを巡る議論は「信じるか否か」ではなく、証拠が十分か、外挿が妥当か、準備が適切かに焦点を移す必要があります。

エビデンスベース:一貫したマルチベンチマーク進展の価値と限界

RSIを裏付ける最も強力な証拠は、単一モデルのブレイクスルーではなく、タスクやシナリオ、評価フレームワーク全体での同期的な進展です。よく引用されるベンチマーク――研究再現性、事後最適化、現実の競技的課題解決、ソフトウェアエンジニアリング課題――はいずれも程度の差こそあれ上昇傾向を示しています。真の価値は「絶対値」ではなく「方向性の一貫性」にあります。複数の代理指標が同時に向上する場合、基礎的な能力全体が底上げされていることを示唆します。

ただし、以下の3つの重要な限界を認識する必要があります。

- ベンチマーク環境は現実と異なります。ベンチマークは明確な境界、安定したフィードバック、再現可能な評価基準を持ちますが、実際のR&Dでは目標の変動、チーム間協働、暗黙知の伝達、リソース制約、組織的摩擦が存在します。制御環境での成功が組織での安定した成果に直結するとは限りません。

- 指標の可視化は能力の完全な把握を意味しません。現行ベンチマークは「問題解決能力」は測りやすいものの、問題定義や優先順位付け、失敗要因の特定、サイクル横断的なガバナンスといった高次のR&D行動は十分に捉えきれません。つまり、「正しい問題を解く」力が向上しても、「常に正しい行動を取る」力が向上するとは限りません。

- トレンドの外挿はボトルネックの移動で妨げられる可能性があります。技術進歩は必ずしも直線的ではありません。あるボトルネックを克服すると、データ品質、ハッシュレートコスト、システム信頼性、コンプライアンス、社会的受容性など新たな制約が現れることがあります。これらの二次的制約を無視すると、進歩を過大評価し、抵抗を過小評価するリスクがあります。

したがって、一貫したマルチベンチマーク進展は強力なシグナルですが、決定的な証拠ではありません。「方向性が重要」であり、「タイムラインが確定している」わけではありません。

本質的な分岐点:能力向上はクローズドループの壁を越えられるか

RSIの本質的な論点は「AIが強くなっているか」ではなく、「その進歩がクローズドループを形成するのに十分かどうか」です。真のクローズドループには、情報の取り込みと文献調査、仮説生成、実験設計と実行、結果評価とエラー診断、戦略の更新と再反復という少なくとも5つの連続ステップが必要です。1つのステップの向上は効率を高めますが、全体の堅牢な統合があってこそ複利的な成果が生まれます。

現時点では、主に最初の3ステップと4番目の一部で進展が見られます。コード生成、実験スクリプト作成、文献要約、パラメータ探索などでモデルの効率が高まっています。クローズドループの最難関は主に2つの能力に集約されます。

- 堅牢な診断力:ノイズの多いデータや矛盾するシグナル、断続的な失敗の中で、表面的な修正に留まらず、真因を正確に特定できるか。

- 目標整合性:複数の制約下で「短期的には非効率でも長期的に有効」な戦略を継続的に実行できるか、単なる局所最適化に陥らないか。

このため、「できる」ことは「責任を持てる」こととは異なります。クローズドループR&Dはモデル能力の総和ではなく、技術・プロセス設計・責任構造の積です。明確な責任追跡や監査メカニズムがなければ、技術がほぼ完成しても組織は安全に権限を委譲できません。

方法論的キャリブレーション:確率・シナリオ分析・意思決定閾値

「2028年までに60%」という表現はコミュニケーション上有用です。想定よりタイムウィンドウが短い可能性を社会に認識させます。しかし、意思決定においてはこうした数値は主観的確率であり、厳密な統計推定値ではありません。より実践的には、ポイント確率を「シナリオ・閾値」フレームワークに変換することが重要です。

有用な3つのシナリオレベルは以下の通りです。

- ベースライン:AIがR&Dに深く統合されつつも、主要な意思決定は人間が担う「高度自動化・人間バックアップ」モデル。

- アクセラレーション:AIが複数領域で準クローズドループ反復を達成し、R&Dサイクルを大幅に短縮。リーダー企業に複利的優位性をもたらす。

- ハイインパクト:領域横断的なクローズドループ能力が出現し、モデルの進化が規制適応を上回り、ガバナンス圧力が高まる。

各シナリオについて、特定年を争うのではなく、明確な閾値指標を設定します。例としては、無人連続反復時間、タスク横断転送成功率、異常検知再現率、自動ロールバック成功率、主要ノードでの手動介入比率などが挙げられます。閾値に達した時点でガバナンス措置を発動し、下回れば制約を緩和します。この手法により、抽象的な予測を実践的なマネジメントに転換できます。

産業への影響:R&D組織はどう変わるか

RSIや準RSIが実現すれば、産業競争の主軸は「モデル性能」から「クローズドループ運用」へと移行します。勝敗は、誰が最大のモデルを持つかではなく、実組織内でより短く、安定し、制御可能なR&Dサイクルを構築できるかにかかっています。

組織の境界線も再編されます。従来のR&Dプロセスは専門職の連なりでしたが、今後は「少数のキーパーソン+大規模AIアフィリエイト」の協働ネットワークへと変化します。役割が消滅するのではなく、システムオーケストレーションや品質管理、リスクガバナンスへと移行します。

効率向上は非線形です。プロセス全体を自動化した組織は、反復速度・コスト構造・実験規模で世代的優位性を得る可能性があります。AIを一部にのみ導入した組織は、線形的で漸進的な改善に留まり、構造的な格差を埋めるのに苦労します。

「信頼できるR&D能力」が新たな競争優位の源泉となります。今後の高付加価値競争力は「速さ」だけでなく、「速く、かつ安全性を証明できる」ことが重視されます。トレーサブルなログ、再現可能な実験、戦略変更の監査、インシデント対応システムは、コンプライアンスコストから市場信頼の資産へと転換します。

ガバナンス課題:加速期における制御可能性の制度設計

加速が現実味を帯びる中、ガバナンスの目標は進歩を止めることではなく、「検証可能な制御可能性」を確立することです。そのためには技術的・制度的ガバナンスを並行して進める必要があります。

技術面では、安全性をR&Dパイプラインに組み込む必要があります。主要意思決定のデフォルトログ化、ハイリスク行動のダブル承認、モデル自己改変のサンドボックス境界、異常な性能ジャンプの強制レビューなどが求められます。中核原則は「権限委譲の前に可観測性を確保する」ことです。

制度面では、階層型ガバナンスを導入し、画一的なルールではなく、リスクの低い用途には柔軟性を認め、高インパクトシステムには透明性と説明責任を強化し、動的なアップデートメカニズムを設けます。静的ルールでは急速な反復に追いつけず、規制自体も「継続的に再調整」できる必要があります。

組織面では、「人間の責任アンカー」を明確にすることが不可欠です。AIがR&Dや導入判断に関与する場合、要所に責任を負う署名者を配置しなければなりません。責任アンカーなき自動化は、速度を上げるだけで質は高まりません。

結論:「高い警戒感・低い確信度」でRSI時代を乗り切る

本論の核心に戻ると、この見解は妥当か?方向性は妥当ですが、表現には慎重さが必要です。AIが複数のR&D次元で進展し、クローズドループの転換点が想定より早く訪れる可能性を指摘する点で妥当です。一方で、特定の時期や確率には主観的仮定が入り、現実の摩擦を過小評価しがちなので、慎重さが不可欠です。

意思決定者にとって最善のアプローチは、楽観と悲観を行き来するのではなく、不確実性の中でレジリエンスを構築することです。

一方では、「加速が予想以上に早く起こる」前提で準備し、重要な局面で受動的にならないようにします。他方では、シナリオ分割・定量的閾値・責任アンカーでシステム拡大を制約し、能力向上を制御可能な範囲に保ちます。

AIの前段階が「機械にタスクを遂行させる」ことだったとすれば、次に問われるべきは「機械が次世代の機械創出を支援し始めるとき、人類はガバナンスと責任体制を同時に進化できるか」です。

これは単なる技術的予測の課題ではなく、イノベーションの未来秩序を再定義する問題です。

関連記事

Render、io.net、Akash:DePINハッシュレートネットワークの比較分析

AI分野におけるRenderの申請理由:分散型ハッシュレートが人工知能の発展を支える仕組み

USD.AI 収益源分析:AIインフラ借入資金による収益創出の仕組み

USD.AIトケノミクス:CHIPトークンの使用事例およびインセンティブメカニズムのデプス分析

GateClawとAI Skills:Web3 AIエージェント能力フレームワークの徹底分析