Akash Networkのプロバイダーメカニズムについてご説明します。分散型GPUプロバイダーエコシステムの詳細ガイドです。

Akash Networkのプロバイダーは、分散型クラウドコンピューティングネットワーク内でリソースを提供する役割を担い、GPU、CPU、サーバーリソースをデベロッパーに貸し出しています。AIモデルのトレーニングや推論需要が急速に拡大する中、グローバルなGPU市場は供給が逼迫し、価格も上昇しています。この結果、未使用のハッシュパワーが分散型マーケットプレイスへと流入し、リソースの効率的な活用が進んでいます。

こうした背景のもと、AkashプロバイダーメカニズムはWeb3 AIインフラの重要な構成要素となっています。従来のクラウドプラットフォームが単一企業によるデータセンター運営であるのに対し、Akashでは個人、マイニングファーム、データセンター、クラウドサービス事業者がGPUマーケットプレイスに直接参加できます。オープンな入札やオンチェーンリースを通じて、プロバイダーは未使用のGPUを取引可能なコンピューティングリソースへと転換し、収益を得ることが可能です。

Akashプロバイダーとは

Akash Networkにコンピューティングリソースを供給するノード運営者であるプロバイダーは、GPU、CPU、メモリ、ストレージ、帯域幅を提供できます。これらのリソースは、AIモデルのデプロイ、機械学習トレーニング、推論サービス、Web3ノード運用、高性能コンピューティングなどに利用されています。

従来型クラウドプラットフォームのような中央集権的なサーバー管理と異なり、Akashプロバイダーは世界中どこからでも参加可能です。理論上、要件を満たすハードウェアを持つ方であれば誰でもネットワークに参加し、ハッシュパワーを提供できます。

Akashプロバイダーの主な役割

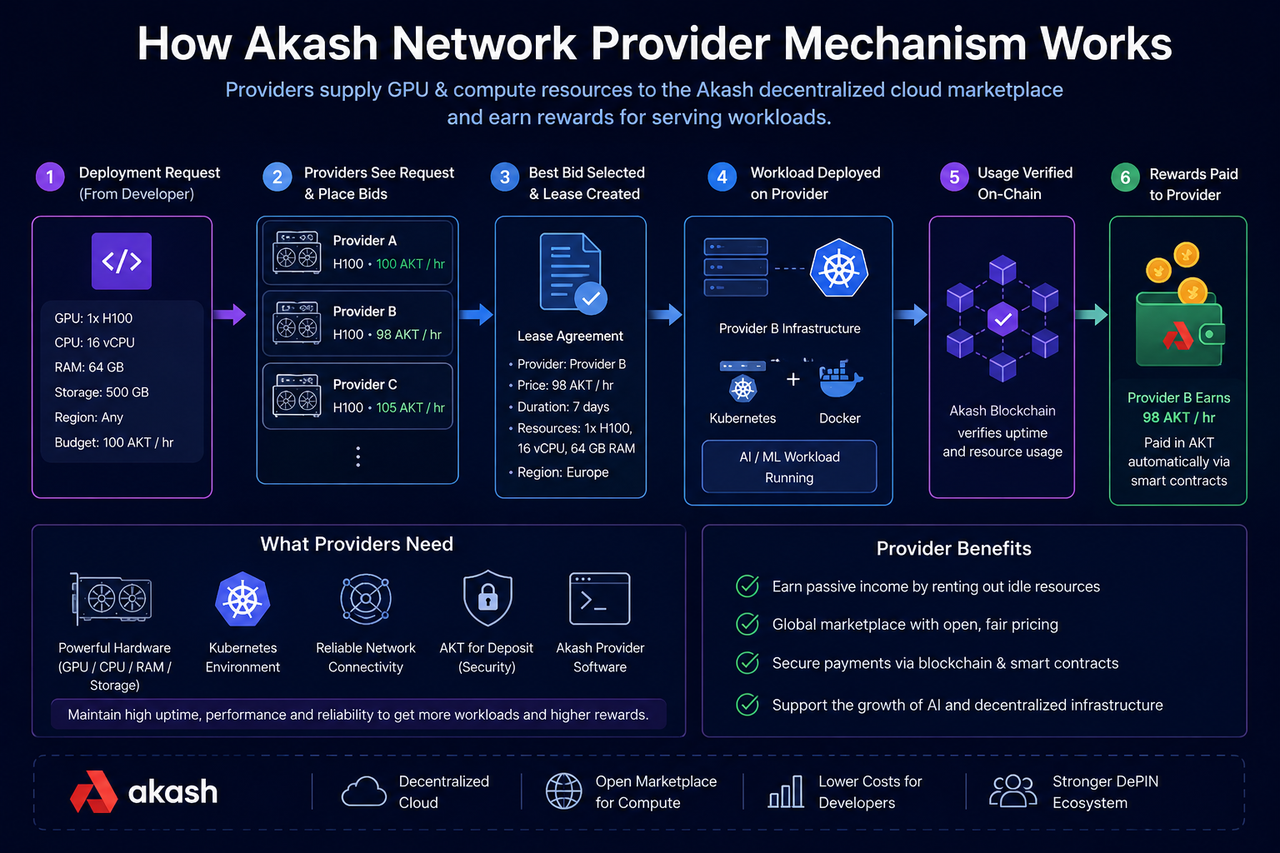

プロバイダーは、Akashの分散型クラウドマーケットプレイスを支える基盤です。デベロッパーがDeployment(デプロイメントリクエスト)を提出した後、プロバイダーが要件に応じてリソース割り当ての入札を行い、該当するワークロードの実行を担います。

プロバイダーの主な責務は以下の通りです。

コンピューティングリソースの提供

プロバイダーは、AIモデルやコンテナ化アプリケーションを稼働させるためのGPU、CPU、サーバーリソースを供給します。

マーケット入札への参加

プロバイダーは、リソース仕様、GPUタイプ、市場需要に応じてオファーを提出します。

ノードの運用・保守

リースが生成された後、プロバイダーはサーバーを安定稼働させ、アプリケーションが正しくデプロイされていることを保証します。

レンタル収益の獲得

デベロッパーのGPU利用料はリース契約に基づきプロバイダーに分配されます。

プロバイダーのAkash Network参加方法

プロバイダーがAkash Networkに参加するには、特定のハードウェアおよび技術要件を満たす必要があります。

まず、Akashはコンテナ化アプリケーションの管理にKubernetesを使用しているため、プロバイダーはKubernetes環境を構築する必要があります。

次に、ノードにはAkash Providerソフトウェアをインストールし、GPUドライバー、ネットワークアクセス、TLS証明書、ウォレットアドレス、リソース設定を構成します。ノードの初期化後、プロバイダーはサーバーリソースをネットワーク上に公開し、Deploymentリクエストの受信を開始できます。

一部プロバイダーはNVIDIA A100やH100などの高性能GPUを提供し、AIモデルの推論やトレーニング市場に参入しています。

プロバイダーの入札メカニズム

Akashはオープンなマーケット入札システムを採用し、コンピューティングリソースを割り当てます。

デベロッパーがDeploymentを提出すると、システムはリソースリクエストをネットワーク全体にブロードキャストします。要件を満たすプロバイダーは、利用可能なリソースに基づいてBid(オファー)を提出できます。

オファーには以下が含まれます。

- GPUモデル

- GPU台数

- CPU・メモリ仕様

- リソース価格

- ノード所在地

- サービス利用可能性

デベロッパーは複数のオファーから選択し、システムがLeaseを生成します。

複数プロバイダーによる注文獲得競争により、市場価格はGPUの供給と需要に応じて動的に変動します。

Lease生成後の流れ

Leaseは、Akash Network内でオンチェーン上に記録されるリソースレンタル契約です。

デベロッパーがプロバイダーのオファーを受け入れると、システムが自動的にLeaseを作成し、両者の情報、GPU構成、レンタル期間、支払い条件、デプロイメント状況を記録します。Lease作成後、プロバイダーはデベロッパーのコンテナイメージを自動で取得し、自身のサーバー上でワークロードをデプロイします。

このプロセスはKubernetesおよびDockerコンテナ技術に基づいており、デベロッパーは従来のクラウドプラットフォームと同様にAIサービスを実行できます。

プロバイダーの収益獲得方法

プロバイダーの主な収益源は、GPUおよびサーバーレンタル料です。

デベロッパーがリソースを利用している間は継続的に料金が発生し、プロバイダーはリースに基づいて収益を受け取ります。

収益に影響を与える主な要素は以下の通りです。

| 影響要因 | 説明 |

|---|---|

| GPUモデル | H100やA100などのハイエンドGPUは一般的に高い収益をもたらします |

| ノードの安定性 | 稼働率の高いプロバイダーほど注文を獲得しやすくなります |

| ネットワーク帯域幅 | 高いネットワーク性能はAI推論ワークロードに有利です |

| 市場需要 | AIブームによりGPUレンタル需要が増加します |

| 地理的ロケーション | 地域によってはデベロッパーにとって魅力的な場合があります |

Akashプロバイダーと従来型クラウドサービスプロバイダーの違い

Akashプロバイダーと従来型クラウドプラットフォームの主な違いは、リソースの組織方法です。

従来型クラウドプラットフォームは大手企業が中央集権的なデータセンターを構築・運営しますが、Akashは世界中の参加者が自由にハッシュパワーを供給できます。

主な違いは以下の通りです。

| 比較項目 | Akashプロバイダー | 従来型クラウドサービスプロバイダー |

|---|---|---|

| リソース所有形態 | 分散型 | 集中型 |

| 価格決定方式 | マーケット入札 | プラットフォーム価格 |

| 参加ハードル | オープン参加 | 企業レベルの運用 |

| GPU供給元 | 世界中の未使用リソース | 公式データセンター |

| リソース拡張性 | 動的スケーリング | 集中拡張 |

ただし、従来型クラウドプラットフォームは安定性、エンタープライズサポート、サービス体制において依然として優れています。

Akashプロバイダーの課題

プロバイダーモデルはGPU市場の開放性を高める一方で、現実的な課題もあります。

プロバイダーにはKubernetes運用、GPU管理、ネットワーク設定などの技術的知識が求められます。

プロバイダーごとにハードウェア品質や安定性が異なり、デベロッパー体験に影響を与えることもあります。

さらに、AI GPU市場の競争は激化しており、io.net、Render、Gensynなども分散型ハッシュパワーマーケットを構築しています。

今後はサービスの安定性、リソース規模、デベロッパーエコシステムがAkashの長期的な競争力の鍵となります。

まとめ

Akash Networkプロバイダーメカニズムは、グローバルなGPUおよびサーバーリソースをオープンなマーケットプレイスで統合し、デベロッパーが柔軟にAIコンピューティングパワーへアクセスできる環境を実現します。

プロバイダーはDeploymentへの入札、ワークロードのデプロイ、サーバー運用の維持によって収益を獲得し、ブロックチェーンがリソース注文やリース決済を管理します。この仕組みにより未使用GPUの活用が進み、分散型AIインフラの発展が促進されます。

よくある質問

誰がAkashプロバイダーになれますか?

要件を満たすハードウェアと技術的知識を持つ個人、マイニングファーム、データセンターなど、どなたでもプロバイダーになることができます。

プロバイダーはどのように収益を得ますか?

プロバイダーはGPUやサーバーリソースをデベロッパーに貸し出すことで収益を得ており、支払いは通常AKTまたはステーブルコインで行われます。

なぜプロバイダーにKubernetesが必要ですか?

Akashはコンテナ化アプリケーションの管理にKubernetesを利用しているため、プロバイダーはKubernetes環境上でデベロッパーのワークロードをデプロイする必要があります。

Akashプロバイダーは従来型クラウドプラットフォームとどう違いますか?

従来型クラウドプラットフォームは中央集権的な企業が運営していますが、Akashプロバイダーはオープンなマーケットプレイスモデルを採用し、世界中の参加者が自由にハッシュパワーを提供できます。

Akashプロバイダーは主にAIアプリケーションを対象としていますか?

現在、AI推論、大規模言語モデルのデプロイ、機械学習タスクなどがAkashプロバイダーの主なユースケースとなっています。

関連記事

ONDOトークン経済モデル:プラットフォームの成長とユーザーエンゲージメントをどのように推進するのか

Render、io.net、Akash:DePINハッシュレートネットワークの比較分析

AI分野におけるRenderの申請理由:分散型ハッシュレートが人工知能の発展を支える仕組み

0xプロトコルの主要コンポーネントは何でしょうか。Relayer、Mesh、APIアーキテクチャの概要をご紹介します。

Plasma(XPL)トークノミクス分析:供給、分配、価値捕捉