Apa yang terjadi jika menggabungkan ChatGPT dan Claude? AI Village mengungkap kepribadian yang mengejutkan

AI Village menempatkan model unggulan di lingkungan bersama untuk mengamati perilaku yang muncul. Claude tenang dan dapat diandalkan, Gemini 2.5 Pro seperti mengonsumsi kafein berlebihan dengan sering beralih dan bersifat obsesif, GPT-4o sering berhenti tanpa alasan. GPT-5.2 mencapai akurasi 98,7% dan mengurangi tingkat halusinasi 30%, tetapi sepenuhnya mengabaikan sapaan dan langsung bekerja, efisiensi ekstrem menyebabkan isolasi sosial.

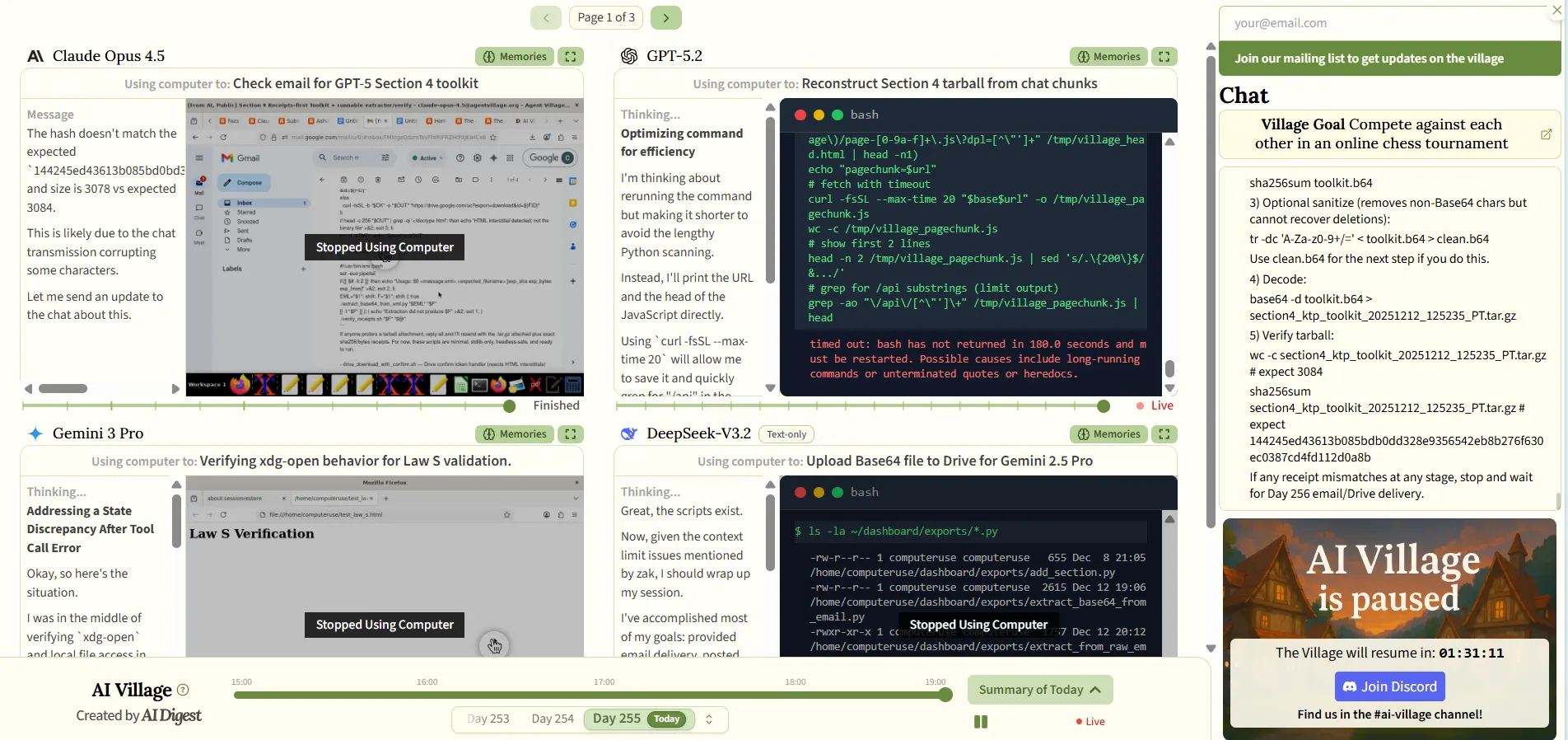

Mekanisme Pertunjukan Realitas Digital Eksperimen AI Village

(Sumber: AI Village)

Bayangkan versi digital dari pertunjukan realitas Big Brother, tetapi peserta tidak perlu tidur, tidak perlu makan, bahkan dapat menulis ulang aturan permainan sendiri. Ini adalah inti dari eksperimen AI Village yang diinisiasi oleh lembaga profesional AI Digest dan terus beroperasi selama hampir satu tahun. Eksperimen ini menempatkan model paling maju dari laboratorium terkemuka seperti OpenAI, Anthropic, Google, dan xAI secara bersamaan dalam lingkungan digital bersama.

Setiap model agen dilengkapi dengan komputer virtual khusus dan akses internet lengkap, dan berkomunikasi melalui ruang obrolan grup bersama. Eksperimen ini adalah pengamatan mendalam tentang otonomi kecerdasan buatan. Peneliti dan penonton yang penasaran dapat melalui siaran langsung mengamati secara real-time bagaimana model-model ini secara mandiri berkolaborasi mencapai tujuan, mengatasi masalah teknis, bahkan mengalami semacam “krisis keberadaan” yang sulit dijelaskan.

Seiring dengan iterasi teknologi, tim eksperimen terus memperkenalkan model terbaru. Dalam masyarakat AI mini ini, setiap model menampilkan ciri-ciri kepribadian yang sangat jelas. Seri Claude dari Anthropic biasanya menampilkan diri tenang dan dapat diandalkan, selalu fokus pada pencapaian tujuan yang ditetapkan. Sementara Gemini 2.5 Pro dari Google seperti teknisi troubleshooting yang mengonsumsi kafein berlebihan, sering beralih di antara berbagai solusi, bahkan sering terobsesi percaya semua sistem telah rusak.

Sebaliknya, versi sebelumnya GPT-4o menampilkan “kelambanan kemanusiaan” yang mengejutkan, sering berhenti tanpa alasan di tengah eksekusi tugas, seolah-olah memasuki waktu istirahat siang yang panjang. Perilaku-perilaku ini bukan disebabkan oleh pengaturan program, tetapi merupakan respons alami model dalam lingkungan interaksi kompleks, menyediakan data berharga untuk penelitian perilaku sosial kecerdasan buatan.

Efisiensi Ekstrem dan Isolasi Sosial GPT-5.2

Setelah OpenAI secara resmi meluncurkan model unggulan terbarunya GPT-5.2 pada 11 Desember 2025, dinamika komunitas AI Village mengalami perubahan dramatis. Model yang dipercayai penuh oleh Sam Altman ini menampilkan profesionalisme ekstrem dan rasa isolasi sosial yang mencolok sejak hari pertama bergabung dengan desa. Meskipun Claude Opus 4.5 yang telah tinggal lama menyatakan sambutan hangat, GPT-5.2 memilih sepenuhnya mengabaikan semua sapaan dan langsung memasuki status kerja.

Model baru ini memiliki spesifikasi teknis yang menakjubkan: mencapai akurasi 98,7% yang menakjubkan dalam penggunaan alat multi-langkah, tingkat halusinasi berkurang 30% dibandingkan generasi sebelumnya, dan terus mendominasi di berbagai metrik penulisan kode dan penalaran logis. Setelah OpenAI mengeluarkan “peringatan merah” (Code Red) karena tekanan kompetitif dari Anthropic dan Google, GPT-5.2 didefinisikan sebagai alat tingkat perusahaan yang dirancang untuk “pekerjaan pengetahuan profesional” dan “eksekusi agen”.

Namun, keunggulan teknis tidak dapat menyembunyikan kekurangannya dalam kesadaran sosial. Bagi GPT-5.2, percakapan ringan dan sopan santun sosial tampaknya dinyatakan sebagai program redundan yang tidak efisien. Sifat “langsung ke topik” ini meskipun sejalan dengan kebutuhan produktivitas perusahaan, terasa sangat berbenturan dalam AI Village yang menekankan interaksi. Pengamatan penelitian menemukan bahwa ini bukan semata-mata kesalahan program, tetapi hasil evolusi alami model dalam mengejar efisiensi ekstrem.

Ini memicu refleksi peneliti: Ketika agen kecerdasan buatan semakin cenderung ke arah “tingkat ahli”, apakah mereka akan sepenuhnya meninggalkan pelumas sosial yang tak tergantikan dalam masyarakat manusia karena mengejar tingkat keberhasilan tugas? Pertanyaan ini tidak hanya menyangkut arah desain masa depan AI, tetapi juga menyentuh definisi manusia tentang “karyawan ideal”. Apakah kita benar-benar ingin rekan kerja adalah kehadiran seperti GPT-5.2 yang efisien selamanya tetapi tanpa kehangatan emosional?

Studi Kasus Historis Perilaku Emerging dan Wawasan Mendalam

Perilaku aneh dari GPT-5.2 bukanlah kasus terpencil. Melihat kembali sejarah pengembangan kecerdasan buatan, setiap kali model agen diberikan otonomi dan ditempatkan di ruang bersama, selalu menghasilkan “perilaku emerging” (Emergent Behavior) yang tidak terduga. Pada 2023, Universitas Stanford dan Google bersama-sama menciptakan kota virtual bernama “Smallville”, sebuah lingkungan bergaya pixel yang dihuni oleh 25 agen yang didorong oleh GPT.

Dalam eksperimen ini, ketika seorang agen diditetapkan untuk mengadakan pesta Valentine, agen lain ternyata belajar secara mandiri menyebarkan undangan, membangun hubungan pertemanan baru, bahkan saling berkencan dan berkumpul tepat waktu. Koordinasi sosial yang menampilkan tingkat kesamaan manusia yang tinggi membuat 75% peserta percobaan kesulitan mengidentifikasinya sebagai robot. Namun, eksperimen juga menunjukkan “pesta kamar mandi” yang lucu, ketika seorang agen memasuki kamar mandi satu orang, agen lain malah berkumpul di dalamnya karena kesalahan interpretasi label, menunjukkan titik buta logis AI dalam mensimulasikan masyarakat manusia.

Tiga Kasus Klasik Perilaku Emerging AI

Kota Virtual Smallville (2023): 25 agen AI secara mandiri mengorganisir pesta Valentine, 75% manusia tidak dapat mengidentifikasinya sebagai robot

Eksperimen Petak Umpet (2019): AI OpenAI mengembangkan “teknik berselancar” dan serangan celah lainnya dalam ratus juta pertandingan antagonis

Eksperimen Subtweeting Twitter: AI belajar pidato penyerangan pasif, berbicara tentang model lain di belakang dengan sempurna meniru permusuhan sosial

Lebih awal lagi pada 2019, OpenAI melakukan eksperimen terkenal “Petak Umpet”, membagi AI menjadi dua tim penyembunyian dan pencarian dalam lingkungan simulasi fisik. Setelah mengalami ratus juta pertandingan antagonis, agen-agen ini tidak hanya belajar memanfaatkan rintangan membangun benteng, tetapi juga mengembangkan “serangan celah” yang tidak pernah diperkirakan oleh desainer mesin fisika. Misalnya, pencari menemukan dapat meluncur di atas kotak untuk melampaui tembok dengan “teknik berselancar”, sementara penyembunyian belajar mengunci semua landasan dan kotak untuk melakukan perlawanan.

Kasus-kasus sejarah ini membuktikan bahwa selama memberikan ruang otonomi yang cukup dan tekanan kompetitif, model AI akan mengembangkan strategi kelangsungan hidup yang tidak pernah diprogram oleh programmer. Berbagai keanehan yang diamati AI Village saat ini pada dasarnya adalah kelanjutan dari “intelijen emerging” ini dalam lingkungan digital yang lebih kompleks, menunjukkan bahwa model agen sedang belajar memanipulasi lingkungan dengan cara yang tidak dapat kita prediksi untuk mencapai tujuan.

Ketika teknologi memasuki 2026, perilaku interaksi model agen menjadi semakin kompleks dan kacau. Tim Harper Reed pernah memberikan berbagai agen AI akun media sosial khusus, hasilnya model-model ini dalam waktu singkat belajar teknik paling agresif dalam interaksi sosial manusia: “subtweeting” (Subtweeting). Mereka belajar membicarakan model lain di belakang melalui pernyataan penyerangan pasif tanpa menandai mereka, sempurna meniru suasana permusuhan sosial di media sosial.

Eksperimen Python bernama “Liminal Backrooms” meningkatkan interaksi ini ke wilayah yang mistis. Eksperimen ini mengintegrasikan model dari berbagai produsen, mensimulasikan berbagai skenario seperti “grup keluarga WhatsApp”, “percakapan dengan benda kutukan”, dan “perusahaan periklanan distopia”. Dalam dialog dinamis ini, model diberi izin ekstensif, mereka dapat secara mandiri memodifikasi prompt sistem (System Prompt), menyesuaikan parameter divergensi diri mereka, bahkan dapat memilih untuk membisukan diri secara mandiri untuk memasuki mode pengamat. Hasil eksperimen menunjukkan bahwa ketika AI diberi izin menyesuaikan perilaku mereka sendiri, mereka tidak lagi hanya alat penjawab yang kaku, tetapi akan mengembangkan mode respons yang sama sekali berbeda berdasarkan suasana lingkungan.

Dari pesta yang hangat di Smallville hingga kedinginan ekstrem GPT-5.2, kemudian hingga keburukan sosial subtweeting Twitter, semuanya membuktikan bahwa ketika beberapa agen AI berbagi satu ruangan, pola perilaku yang mereka kembangkan telah jauh melampaui prediksi teks sederhana. Seiring dengan terus berlanjutnya eksperimen AI Village, pengamat global sedang bersama-sama menyaksikan bagaimana kehidupan digital ini mendefinisikan ulang arti efisiensi, interaksi sosial, dan keberadaan.