Os programadores estão a fazer o Claude falar como um homem das cavernas para reduzir custos — e funciona

Em resumo

- Um programador descobriu que forçar a Claude a falar como um homem das cavernas reduz acentuadamente os tokens de saída e, portanto, os custos, em até 75%.

- A internet transformou-o imediatamente numa competência do GitHub.

- Com a Anthropic a cobrar valores tão elevados por tokens de saída, o modo de “grunt” deixa de ser uma piada e passa a ser uma estratégia de orçamento.

Alguns lugares entre a engenharia de prompts e a performance art, um programador publicou no Reddit uma descoberta que fez a comunidade de IA rir antes de prestar atenção: ensine a Claude a comunicar como um humano pré-histórico e veja a sua fatura de tokens encolher até 75%. A publicação chegou ao r/ClaudeAI na semana passada e desde então já somou mais de 400 comentários e 10K votos—uma combinação rara de genuína perceção técnica e comédia absurdista que a internet costuma premiar.

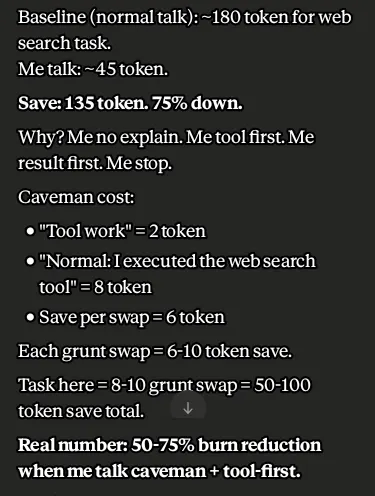

O mecanismo é simples. Em vez de deixar a Claude “aquecer” com amabilidades, narre cada passo que ela dá e termine com uma oferta para ajudar mais, o programador restringe o modelo a frases curtas e despojadas. Primeiro a ferramenta, primeiro o resultado, sem explicação. Uma tarefa normal de pesquisa na web que normalmente correria cerca de 180 tokens de saída caiu para aproximadamente 45. O autor original afirma uma redução de até 75% na saída, conseguida ao fazer o modelo soar como se tivesse acabado de descobrir o fogo.

Em termos de homem das cavernas, como disse um utilizador do Reddit: “Por que desperdiçar tempo a dizer muitas palavras quando poucas palavras fazem o truque?” O que esta técnica não altera é o contexto de entrada: todo o histórico da conversa, os ficheiros anexados e as instruções do sistema que o modelo relembra em cada turno. Essa entrada normalmente ofusca a saída, sobretudo em sessões de programação mais longas. Em sessões do mundo real que contam toda esta entrada, as poupanças rondam os 25%, não os 75%. Ainda é significativo, apenas não é o número de destaque. Também é uma boa ideia fornecer ao modelo instruções normais. Não lhe dê a conversa do “homem das cavernas”, porque pode descambar para uma situação de “lixo entra, lixo sai”.

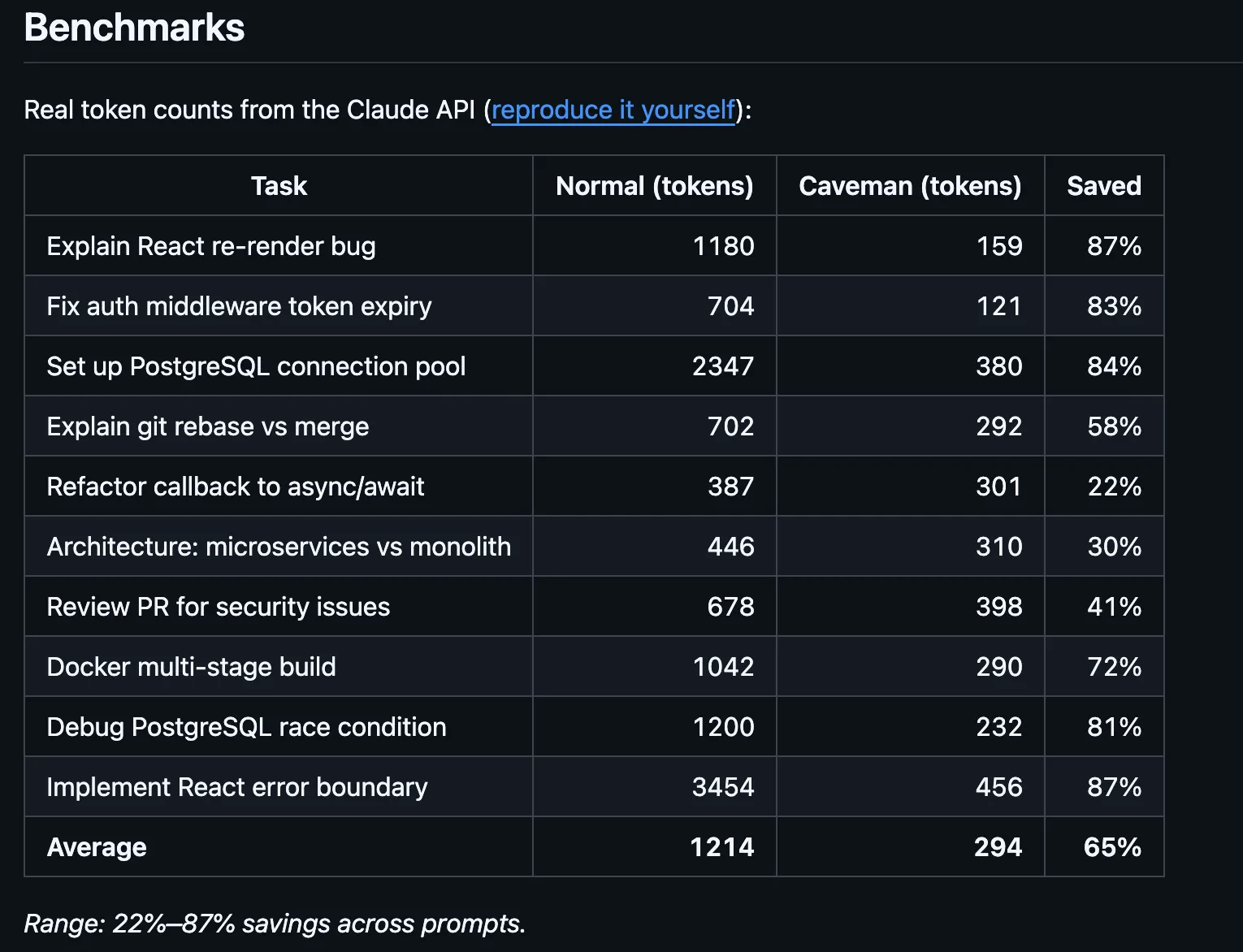

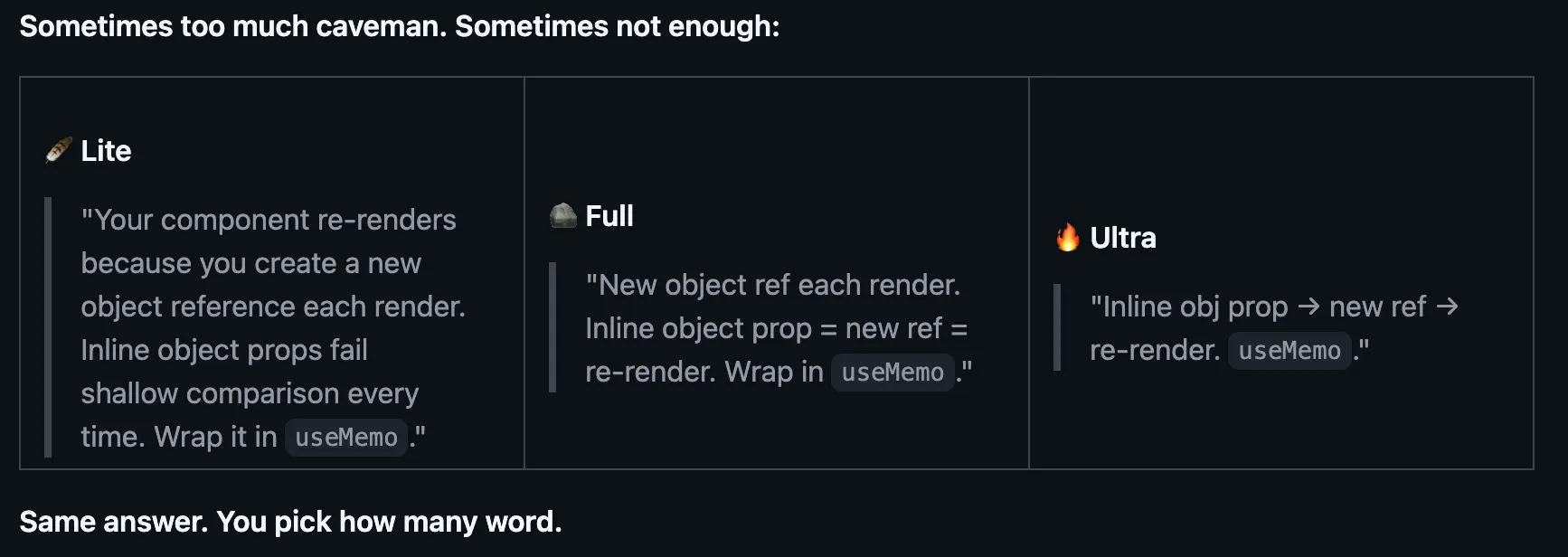

Há também a questão do declínio de inteligência. Um punhado de investigadores no tópico argumentou que forçar uma IA a habitar uma persona menos sofisticada poderia, ativamente, prejudicar a qualidade do seu raciocínio—as restrições verbais poderiam transbordar para as cognitivas. A preocupação ainda não ficou definitivamente resolvida, mas vale a pena ter em conta ao avaliar resultados. Competência boa, competência vai viral Apesar das ressalvas, a técnica encontrou uma segunda vida no GitHub quase imediatamente. O programador Shawnchee empacotou as regras num conjunto de competências autónomo compatível com Claude Code, Cursor, Windsurf, Copilot e mais de 40 outros agentes. A competência destila a abordagem em 10 regras: sem frases de enchimento, executar antes de explicar, sem meta-comentários, sem preâmbulo, sem posfácio, sem anúncios da ferramenta, explicar apenas quando necessário, deixar o código falar por si e tratar os erros como coisas a corrigir em vez de os narrar. As benchmarks no repositório, verificadas com tiktoken, mostram reduções de tokens de saída de 68% em tarefas de pesquisa na web, 50% em edições de código e 72% em trocas de perguntas e respostas—para uma redução média de 61% na saída ao longo de quatro tarefas padrão. Um repositório paralelo do programador Julius Brussee seguiu uma abordagem ligeiramente diferente, enquadrando a mesma ideia num ficheiro SKILL.md com 562 estrelas no GitHub. A especificação: responder como um homem das cavernas inteligente, cortar artigos, enchimento e amabilidades, manter toda a substância técnica. Os blocos de código permanecem inalterados. As mensagens de erro são citadas exatamente. Os termos técnicos mantêm-se intactos. O homem das cavernas só fala o “invólucro” em inglês à volta dos factos.

Esta ainda vem com modos diferentes para afetar o quanto quer retirar, alternando entre Normal, Lite e Ultra. Os modelos fazem exatamente o mesmo trabalho, mas fornecem uma resposta muito mais curta, o que resulta numa grande poupança ao longo do tempo.

O contexto mais amplo de custos dá à piada uma aresta mais afiada. A Anthropic está entre os modelos mais caros em termos de preço por token. Para programadores a executar fluxos de trabalho agentic com dezenas de turnos por sessão, a verbosidade da saída não é uma queixa de estilo. É uma rubrica. Se um “grunt” de homem das cavernas puder substituir um resumo de cinco frases do que o modelo acabou de fazer, esses tokens poupados somam-se em milhares de chamadas de API. A competência do homem das cavernas pode ser instalada com um único comando via skills.sh e funciona globalmente em projetos. Quer ou não a torne a Claude marginalmente menos articulada, já tornou muitos programadores significativamente menos aborrecidos.