Как функционирует сеть Dolphin? Полный разбор децентрализованного процесса вывода с использованием ИИ.

Быстрое развитие моделей искусственного интеллекта приводит к стремительному росту мирового спроса на GPU. По мере масштабирования крупных языковых моделей (LLM), ИИ-агентов и автоматизированных приложений традиционные централизованные облачные платформы искусственного интеллекта сталкиваются с высокими затратами, концентрацией ресурсов и ограничениями масштабируемости. В этой ситуации децентрализованные GPU-сети становятся ключевым направлением развития инфраструктуры Web3 AI.

Dolphin Network — это сеть ИИ-инференса, созданная в ответ на этот тренд. Ее главная цель — объединить распределенные по всему миру GPU-ресурсы в открытую инфраструктуру искусственного интеллекта и обеспечить координацию разработчиков, GPU-узлов и самой сети через стимулирующий механизм POD.

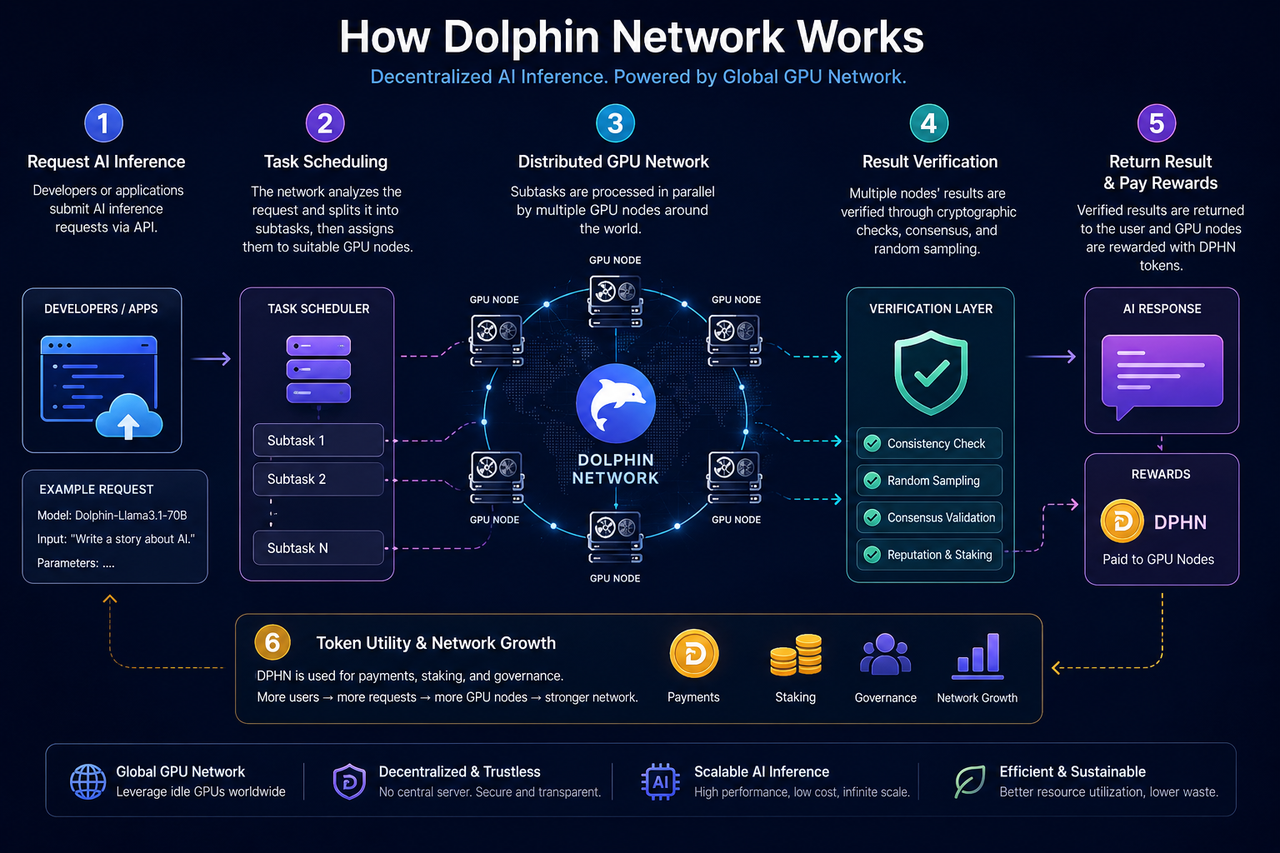

Как устроена Dolphin Network?

В основе архитектуры Dolphin Network лежат три компонента: инициаторы запросов на ИИ-инференс, сеть GPU-узлов и механизм верификации и координации.

Разработчики или приложения могут отправлять в сеть запросы на ИИ-инференс — например, генерацию текста, инференс в чате, вызов модели или задачи для ИИ-агентов. Система динамически распределяет запросы между подходящими узлами с учетом статуса GPU-узлов, требований задачи и доступности ресурсов.

GPU-узлы предоставляются пользователями по всему миру. Любой участник может подключить неиспользуемую GPU, выполнять задачи инференса локально и получать токен-награды за свой вклад.

Чтобы обеспечить достоверность результатов, Dolphin применяет механизмы верификации и экономического стимулирования для координации работы узлов, включая случайную выборку, проверку задач и системы стекинга.

Как запросы на ИИ-инференс поступают в сеть?

При взаимодействии разработчика с Dolphin Network запросы сначала поступают на уровень планирования задач.

Здесь анализируются тип задачи, требования к GPU и особенности модели. Разные ИИ-модели требуют различной конфигурации памяти, скорости инференса и вычислительной мощности, поэтому сеть динамически сопоставляет запросы с подходящими узлами по их статусу.

В централизованных облачных платформах ИИ этим процессом управляет единый дата-центр. В Dolphin задачи распределяются по децентрализованной сети GPU-узлов.

Для повышения эффективности и одновременности некоторые задачи могут быть разбиты на несколько небольших запросов инференса.

Как GPU-узлы обрабатывают задачи ИИ-инференса?

GPU-узлы — это основные вычислительные ресурсы Dolphin Network.

Операторы узлов устанавливают специальное программное обеспечение и разрешают системе использовать локальные GPU для задач ИИ-инференса. При получении задачи узел загружает необходимую модель или параметры инференса и выполняет вычисления локально.

После завершения работы узел отправляет результаты инференса в сеть и ожидает верификации для подтверждения их корректности. Только задачи, прошедшие верификацию, получают токен-награды.

Этот подход отличается от классического GPU-майнинга. Если в PoW-сетях ключевую роль играет вычисление хэшей, то GPU-узлы Dolphin выполняют реальные задачи ИИ-инференса, что приближает их к «рынку доступной мощности хэша».

Как Dolphin проверяет результаты ИИ-инференса?

В отличие от стандартных блокчейн-транзакций, результаты инференса ИИ нельзя подтвердить простыми математическими формулами. Поэтому Dolphin использует дополнительные механизмы, чтобы предотвратить отправку неверных результатов.

Один из способов — случайная выборка: задачи выбираются случайным образом для проверки, чтобы подтвердить一致ие результатов между несколькими узлами. Систематическая отправка аномальных данных снижает репутацию узла или лишает его права на вознаграждение.

В некоторых децентрализованных ИИ-сетях также применяется стекинг. Узлы обязаны стейкать токены для участия, а за злонамеренные действия их стекинговые активы могут быть частично списаны.

В целом такие экономические стимулы способствуют корректному поведению узлов и повышают доверие к сети.

Чем Dolphin отличается от классического облачного ИИ-инференса?

Традиционные облачные платформы ИИ работают на крупных централизованных дата-центрах — одна организация управляет кластерами GPU, развертыванием моделей и API-сервисами.

Dolphin использует открытую архитектуру GPU-сети. GPU-узлы подключаются пользователями по всему миру, что позволяет разработчикам получать доступ к сервисам ИИ-инференса в более открытой среде и снижает зависимость от единого поставщика.

Dolphin делает акцент на открытых ИИ-моделях и совместном использовании ресурсов. В некоторых сетях поддерживается развертывание open-source моделей, индивидуальные системные правила и открытые сценарии для ИИ-агентов.

Однако распределенные ИИ-сети сталкиваются с такими трудностями, как стабильность, задержки в сети и различия в качестве узлов, поэтому они пока находятся на этапе становления.

Какие вызовы стоят перед Dolphin Network?

Децентрализованные сети ИИ-инференса обеспечивают открытость и совместное использование ресурсов, но сталкиваются с рядом практических проблем.

Во-первых, производительность GPU-узлов сильно различается: объем памяти, пропускная способность и возможности инференса могут влиять на стабильность всей сети.

Во-вторых, верификация результатов ИИ-инференса сложна. В отличие от блокчейн-транзакций, результаты ИИ вероятностны, что увеличивает затраты на проверку.

По мере увеличения размеров моделей ИИ эффективное управление масштабными кластерами GPU в распределенной среде становится ключевой задачей для проектов AI DePIN.

Также сохраняется регуляторная неопределенность. Открытые ИИ-модели могут вызывать вопросы, связанные с данными, авторским правом и генерацией контента, поэтому инфраструктурные сети ИИ должны учитывать долгосрочные регуляторные риски.

Кратко

Dolphin Network — это децентрализованная сеть ИИ-инференса, сочетающая ИИ и DePIN, с целью создания открытой инфраструктуры искусственного интеллекта на базе глобальных GPU-узлов. Сеть координирует работу разработчиков и GPU-узлов через планирование задач, распределенный инференс, случайную верификацию и стимулирующий механизм DPHN.

В отличие от традиционных централизованных облачных платформ ИИ, Dolphin делает ставку на открытость, совместное использование ресурсов и устойчивость к цензуре, что выводит ее в число лидирующих направлений инфраструктуры Web3 AI.

Часто задаваемые вопросы

Как Dolphin использует GPU-узлы?

Держатели GPU могут развернуть узлы и предоставить неиспользуемые ресурсы GPU для выполнения задач ИИ-инференса и получения вознаграждений DPHN.

Какие этапы включает процесс ИИ-инференса в Dolphin?

Основные этапы: отправка задачи, планирование узлов, выполнение инференса на GPU, верификация результатов, распределение вознаграждений.

Почему Dolphin считается проектом DePIN?

Его ключевые ресурсы — реальное GPU-оборудование, а распределенная инфраструктура координируется через токен-стимулы.

Чем Dolphin отличается от традиционных облачных платформ ИИ?

Традиционные облачные платформы ИИ зависят от централизованных дата-центров; Dolphin использует открытую сеть GPU для распределенного ИИ-инференса.

Какова роль DPHN в сети?

DPHN используется для оплаты инференса ИИ, вознаграждения узлов, стекинга и как экономический стимул внутри сети.

Похожие статьи

Экономическая модель токена ONDO: каким образом она способствует развитию платформы и повышает вовлеченность пользователей?

Как Midnight обеспечивает конфиденциальность в блокчейне? Обзор доказательств с нулевым разглашением и программируемых механизмов приватности

Взаимосвязь между Midnight и Cardano: как сайдчейн конфиденциальности расширяет экосистему приложений Cardano

Что такое Tronscan и как вы можете использовать его в 2025 году?

Какие задачи решает токен ST? Детальный анализ механизма поощрений в экосистеме Sentio