Anthropic ฟ้องศาล! กล่าวหารัฐบาลทรัมป์ตอบโต้ด้วยการปิดกั้น Claude, นักวิจัย AI จำนวน 37 คนสนับสนุน

Anthropic ฟ้องรัฐบาลกลาง คัดค้านการจัดเป็น “ความเสี่ยงในห่วงโซ่อุปทาน” และหยุดใช้ Claude เป็นเวลา 6 เดือน ความขัดแย้งด้านการใช้งาน AI ในทางทหารและการบริหารความปลอดภัยทวีความรุนแรงขึ้น

ถูกจัดเป็น “ความเสี่ยงในห่วงโซ่อุปทาน” Anthropic ฟ้องรัฐบาลกลาง

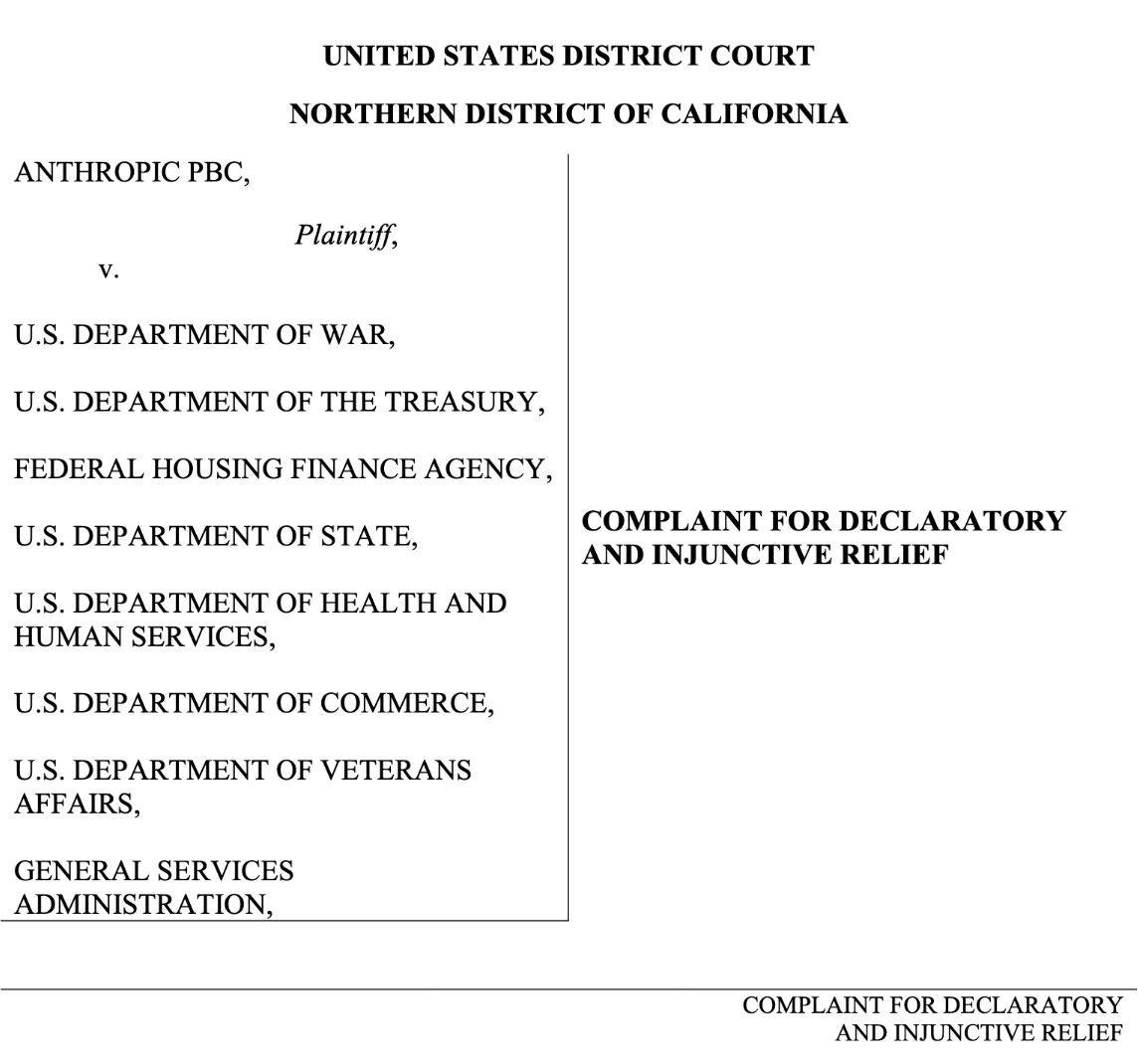

บริษัทปัญญาประดิษฐ์ Anthropic เมื่อเร็ว ๆ นี้ได้ยื่นฟ้องต่อศาลรัฐบาลกลางสหรัฐ โดยกล่าวหาว่ารัฐบาลทรัมป์ได้จัดให้บริษัทเป็น “ความเสี่ยงในห่วงโซ่อุปทาน” (supply chain risk) และเรียกร้องให้หน่วยงานของรัฐบาลหยุดใช้ระบบ AI ของบริษัท คำกล่าวอ้างนี้เป็นการตอบโต้เชิงการเมืองและการกดดันทางการค้า ศาลได้รับคำฟ้องแล้วในศาลแขวงสหรัฐประจำเขตแคลิฟอร์เนียตอนเหนือ

ในคำฟ้อง Anthropic ระบุว่าการดำเนินการของรัฐบาลขาดฐานทางกฎหมาย และส่งผลกระทบอย่างรุนแรงต่อการดำเนินธุรกิจและความสัมพันธ์ทางธุรกิจของบริษัท เอกสารฟ้องร้องระบุว่าหน่วยงานและเจ้าหน้าที่ของรัฐบาลหลายแห่งเป็นจำเลย รวมถึงกระทรวงกลาโหม สตีฟ เฮกเซท (Pete Hegseth) รัฐมนตรีคลัง สก็อตต์ เบสเซนต์ (Scott Bessent) รัฐมนตรีต่างประเทศ มาร์โก รูบิโอ (Marco Rubio) และรัฐมนตรีพาณิชย์ ฮาวเวิร์ด ลัทนิก (Howard Lutnick)

ที่มา: Anthropic Anthropic ยื่นฟ้องต่อศาลรัฐบาลกลางสหรัฐ กล่าวหาว่ารัฐบาลทรัมป์ได้จัดให้บริษัทเป็น “ความเสี่ยงในห่วงโซ่อุปทาน” และเรียกร้องให้หน่วยงานของรัฐบาลหยุดใช้ระบบ AI ของบริษัท

คำว่า “ความเสี่ยงในห่วงโซ่อุปทาน” มักใช้กับบริษัทเทคโนโลยีที่เกี่ยวข้องกับประเทศศัตรู เช่น ผู้ให้บริการที่อาจมีมัลแวร์หรือซอฟต์แวร์อันตราย Anthropic ชี้ให้เห็นว่าการจัดให้บริษัท AI ของอเมริกาอยู่ในกลุ่มนี้ ส่งผลกระทบต่อชื่อเสียงและความร่วมมือทางธุรกิจอย่างชัดเจน Anthropic ระบุว่าบริษัทใช้กระบวนการทางกฎหมายเพื่อชี้แจงว่าการดำเนินการของรัฐบาลนั้นถูกต้องตามกฎหมายหรือไม่ พร้อมทั้งปกป้องผลประโยชน์ของบริษัท ลูกค้า และพันธมิตร

ความขัดแย้งด้านการใช้งาน AI ในทางทหาร การเจรจาสัญญา AI ด้านกลาโหมล้มเหลว

แกนหลักของความขัดแย้งนี้มาจากความแตกต่างในการใช้งานเทคโนโลยี AI ระหว่าง Anthropic กับกระทรวงกลาโหมสหรัฐฯ ก่อนหน้านี้ Anthropic เคยเจรจาสัญญา AI มูลค่าสูงสุดประมาณ 200 ล้านดอลลาร์ กับกระทรวงกลาโหม สหรัฐฯ ในระหว่างการเจรจา กระทรวงกลาโหมได้เรียกร้องให้ระบบ AI ต้องสามารถใช้งานได้ในทุกวัตถุประสงค์ที่ถูกกฎหมาย รวมถึงในบริบททางทหาร ซึ่ง Anthropic ยืนหยัดที่จะรักษาข้อจำกัดด้านความปลอดภัยไว้ 2 ข้อ คือ

- ห้ามใช้โมเดล AI ชื่อ Claude สำหรับการสอดแนมประชาชนจำนวนมาก

- ห้ามใช้ในระบบอาวุธที่ทำงานโดยอัตโนมัติเต็มรูปแบบ

บริษัทเชื่อว่าข้อจำกัดเหล่านี้เป็นหลักการสำคัญด้านความปลอดภัยของ AI ทั้งสองฝ่ายไม่สามารถตกลงกันได้ ในเดือนกุมภาพันธ์ ค.ศ. 2026 รัฐบาลสหรัฐฯ ได้จัดให้ Anthropic เป็น “ความเสี่ยงในห่วงโซ่อุปทาน” และสั่งให้หน่วยงานของรัฐหยุดใช้ระบบ Claude ภายใน 6 เดือน

ในคำฟ้อง Anthropic ระบุว่ารัฐบาลใช้สิทธิ์ตามอำนาจบริหารในการกดดันบริษัท พยายามบีบบังคับให้ปรับนโยบายด้านความปลอดภัยของ AI ทนายความของบริษัทกล่าวว่ารัฐธรรมนูญของสหรัฐฯ ไม่อนุญาตให้รัฐบาลลงโทษบริษัทเพราะแสดงจุดยืนสาธารณะ

อ่านเพิ่มเติม

ความมั่นคงแห่งชาติ VS จริยธรรม: Anthropic ปฏิเสธการถอดฟีเจอร์ความปลอดภัยของ Claude โต้เถียงกับกระทรวงกลาโหมสหรัฐฯ

เสียงสนับสนุนจากอุตสาหกรรมเทคโนโลยี 37 นักวิจัย AI ยื่นคำแถลงต่อศาล

ความขัดแย้งระหว่าง Anthropic กับรัฐบาล ได้กลายเป็นประเด็นถกเถียงในอุตสาหกรรมเทคโนโลยี หลังจากยื่นฟ้องไม่นาน นักวิจัย AI จากบริษัท OpenAI และ Google รวม 37 คน ได้ยื่นคำแถลงต่อศาล แสดงการสนับสนุน Anthropic นักวิจัยเหล่านี้เห็นว่าหากรัฐบาลใช้มาตรการลงโทษบริษัทเพราะความแตกต่างด้านนโยบายด้านความปลอดภัยของ AI อาจเป็นการลดความสามารถในการแข่งขันของสหรัฐฯ ในอุตสาหกรรม AI

ในคำแถลง ระบุว่าหากรัฐบาลใช้เหตุผลด้านความมั่นคงของชาติในการกดดันบริษัท AI จะส่งผลกระทบต่ออุตสาหกรรมเทคโนโลยีและสภาพแวดล้อมการวิจัยในระยะยาว นักวิชาการบางคนยังชี้ให้เห็นว่า “ความเสี่ยงในห่วงโซ่อุปทาน” มักใช้ในบริบทที่เกี่ยวข้องกับความปลอดภัยของซอฟต์แวร์จากต่างประเทศ ซึ่งกรณีของ Anthropic แตกต่างจากความเสี่ยงเหล่านี้อย่างชัดเจน

Ben Goertzel ซีอีโอของ SingularityNET ซึ่งเป็นบริษัทด้าน AI กล่าวว่า การปฏิเสธไม่ให้ AI ถูกนำไปใช้ในงานสอดแนมขนาดใหญ่หรือในอาวุธที่ฆ่าโดยอัตโนมัติ ไม่ถือเป็นภัยคุกคามด้านความปลอดภัย หากกองทัพต้องการใช้งานในลักษณะนี้ ก็สามารถเลือกใช้ระบบ AI อื่นได้

ที่มา: DigFin Ben Goertzel ซีอีโอของ SingularityNET

ความขัดแย้งระหว่างรัฐบาลและอุตสาหกรรมเทคโนโลยีทวีความรุนแรงขึ้น ขยายประเด็นนโยบาย AI

เมื่อเกิดคดีฟ้องร้องขึ้น ทำเนียบขาวได้ออกมาตอบสนองอย่างรวดเร็ว โดยระบุว่ารัฐบาลจะไม่อนุญาตให้บริษัทจำกัดการใช้งานเทคโนโลยีสำคัญของกองทัพสหรัฐฯ โฆษกทำเนียบขาวกล่าวว่ารัฐบาลสหรัฐฯ ต้องมั่นใจว่ากองทัพสามารถใช้งานเทคโนโลยีที่จำเป็นในกรอบกฎหมาย เพื่อรักษาความมั่นคงของประเทศ

ความขัดแย้งนี้ยังเชื่อมโยงกับประเด็นนโยบายเทคโนโลยีในวงกว้าง ก่อนหน้านี้ รัฐบาลทรัมป์ได้ผ่อนคลายข้อจำกัดการส่งออกชิป AI ไปยังจีน และวิพากษ์วิจารณ์จุดยืนทางการเมืองของบริษัทเทคโนโลยีบางแห่ง ทำให้ความสัมพันธ์ระหว่างซิลิคอนวัลเลย์กับวอชิงตันตึงเครียดมากขึ้น

Anthropic ระบุว่าหลังจากถูกขึ้นบัญชีดำ บางบริษัทที่ร่วมงานกับกระทรวงกลาโหมอาจต้องพิสูจน์ว่าระบบของตนไม่ได้ใช้ Claude ซึ่งอาจส่งผลต่อความร่วมมือทางธุรกิจในอนาคต

บางบริษัทเทคโนโลยีรายใหญ่ยังคงแสดงจุดยืนสนับสนุน Anthropic เช่น Google ระบุว่าจะยังคงให้บริการเทคโนโลยี AI ของ Anthropic แก่ลูกค้าบนคลาวด์ แต่จะไม่เกี่ยวข้องกับการใช้งานด้านกลาโหม Microsoft และ Amazon ก็แสดงความตั้งใจที่จะดำเนินความร่วมมือทางธุรกิจกับบริษัทต่อไป

Anthropic ยื่นคำร้องต่อศาลเพื่อให้ประกาศว่าการดำเนินการของรัฐบาลเป็นการละเมิดกฎหมาย และขอให้หยุดบังคับใช้ “ความเสี่ยงในห่วงโซ่อุปทาน” หลังจากคดีเข้าสู่กระบวนการทางกฎหมาย การถกเถียงเรื่องความปลอดภัยของ AI ความมั่นคงของประเทศ และอำนาจในการควบคุมของบริษัท ก็ยังคงดำเนินต่อไปอย่างต่อเนื่อง

อ่านเพิ่มเติม

ความร่วมมือของ OpenAI กับกองทัพสหรัฐฯ เผชิญแรงต่อต้าน! ดาวน์โหลด Claude App แล้วเข้าใจจริยธรรมและการเมืองเบื้องหลัง

วอชิงตันโพสต์: หลังจากทรัมป์ออกคำสั่งห้าม Anthropic สหรัฐฯ-อิสราเอลยังคงพึ่งพา Claude ในการโจมตีอิหร่าน