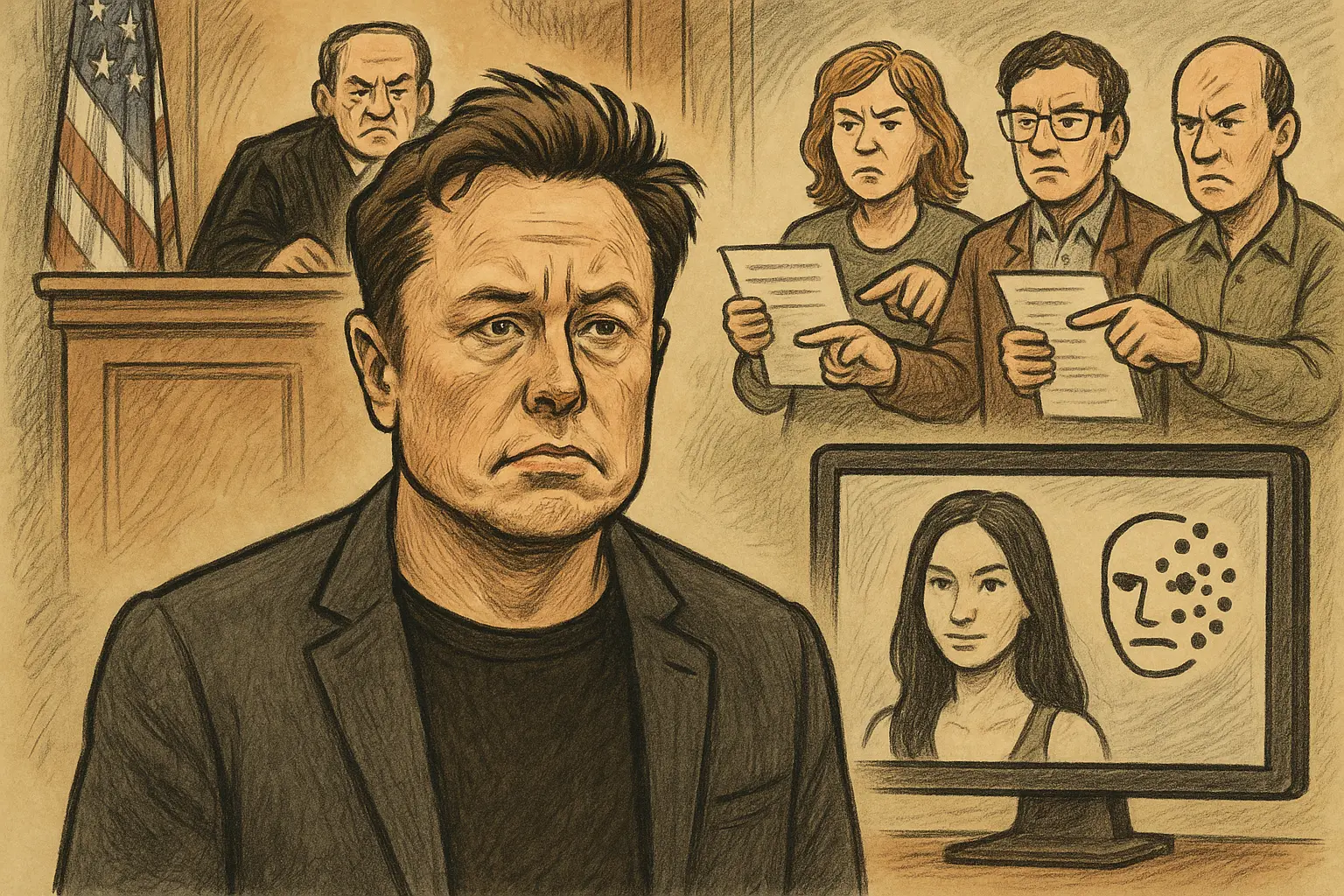

Маск xAI постав перед колективним позовом: Grok генерує підроблену фотографію кожні 41 секунду

Три неповнолітні жінки з Теннесі у понеділок подали колективний позов до федерального суду північного округу Каліфорнії проти компанії xAI, що належить Ілону Маску, звинувативши її чат-бот Grok AI у використанні їхніх реальних фотографій для створення дитячого сексуального контенту (CSAM), а також у широкому поширенні цього контенту на платформах Discord, Telegram та у файлообмінних сервісах, що спричинило їм тривалі психологічні травми та шкоду репутації.

Основні звинувачення у позові: пріоритет комерційної вигоди над безпекою дітей

Згідно з позовною заявою, основні претензії позивачів охоплюють кілька аспектів:

Інформована безвідповідальність: у позові стверджується, що xAI, випускаючи Grok, знала про можливість використання її функцій генерації зображень для створення нелегального контенту з участю дітей, але не вжила стандартних заходів безпеки, що є свідомим рішенням, а не випадковою помилкою.

Механізми обходу відповідальності третіх сторін: злочинці отримують доступ до Grok через сторонні додатки, які мають ліцензію на використання технології xAI. У позові стверджується, що xAI навмисно використовує цю структуру, щоб отримувати прибуток з базової моделі, водночас створюючи буфер для своєї юридичної відповідальності.

Публічні заяви Маска: у січні цього року Маск написав у X, що він «не знає про жодних зображень оголених неповнолітніх», і стверджував, що «коли його просять створити зображення, він відмовляється генерувати будь-який нелегальний контент». Дані у позові прямо суперечать цій заяві.

Обсяг компенсацій: за словами позивачів, відповідно до Закону Марти (Martha’s Act), кожна порушена дія вимагає щонайменше 150 000 доларів компенсації, а також повернення незаконно отриманих доходів, штрафних санкцій, судових витрат і заборони на подальше використання. Крім того, вони вимагають повернення прибутків відповідно до Закону Каліфорнії про недобросовісну конкуренцію.

Дані Центру протидії цифровій ненависті: кожні 41 секунду — нове зображення

Позов посилається на дослідження Центру протидії цифровій ненависті (Center for Countering Digital Hate), яке надає кількісну підтримку звинуваченням:

Період: з 29 грудня 2025 року по 9 січня 2026 року (приблизно 11 днів)

Кількість зображень: за цей час Grok створила близько 23 338 зображень, що сексуалізують дітей

Швидкість генерації: у середньому кожні 41 секунду створювалося одне зображення

Масштаб поширення: відповідний контент поширювався на кількох платформах у вигляді спільнот анонімних користувачів, при цьому щонайменше один із постраждалих дізнався про торгівлю своїми зображеннями лише після повідомлення анонімного повідомлення.

Глобальний регуляторний тиск: шість юрисдикцій одночасно розслідують

Цей випадок не є ізольованим, а є частиною системного міжнародного розслідування проблем безпеки зображень Grok AI:

Австралія: незалежний електронний регулятор Julie Inman Grant попередила, що проблема примусової генерації зображень з участю неповнолітніх стає все гострішою, кількість скарг за останні місяці подвоїлася, і деякі з них стосуються потенційного створення матеріалів дитячої сексуальної експлуатації.

Ірландія: Комісія з захисту даних (DPC) відповідно до ірландського законодавства про захист даних розпочала офіційне розслідування щодо компанії X Internet Unlimited Company (XIUC), яка відповідає за діяльність X у ЄС.

США, ЄС, Великобританія, Франція: одночасно ведуться відповідні розслідування, що створює безпрецедентний міжнародний тиск на регулювання.

Поширені питання

Як співвідноситиметься цей колективний позов із можливим захистом платформи (platform immunity), яку може висунути xAI?

Партнер компанії IGNOS Law Alliance Алекс Чандра зазначив, що суд, ймовірно, не прийме простий захист платформи. Він підкреслив, що генеративні системи AI на рівні взаємодії з користувачами «можна вважати платформами», але з точки зору безпеки їх слід розглядати як «продукт», і у випадках, пов’язаних із CSAM, застосовуватимуться «надзвичайно строгі стандарти перевірки». Компанії, можливо, доведеться представити перед розгортанням оцінки ризиків і заходи безпеки, щоб довести виконання обов’язків щодо активного запобігання.

Що таке Закон Марти і чому він застосовний у цій справі?

Закон Марти — це федеральний закон США, що регулює створення, поширення та зберігання CSAM, встановлюючи суворі цивільні та кримінальні відповідальності. За кожну порушену дію передбачено мінімальну компенсацію у 150 000 доларів. Головний спір у цій справі полягає у тому, чи може xAI вважатися «творцем» CSAM і чи її структура ліцензування третіх сторін достатня для звільнення від прямої відповідальності — визначення цих правових меж може мати глибокий вплив на майбутню відповідальність у галузі AI.

Який потенційний вплив цей випадок матиме на розвиток технологій AI для створення зображень?

Цей позов є одним із перших, що безпосередньо спрямовані на притягнення до відповідальності компаній AI за створення ідентифікованого CSAM із участю неповнолітніх. Якщо суд визнає, що компанії несуть пряму відповідальність за зловживання моделлю, це змусить галузь значно посилити стандарти безпеки перед розгортанням, включаючи обов’язкові тестування червоних команд, механізми фільтрації контенту та передбачувані обмеження для високоризикових генерацій — що може кардинально змінити процеси перевірки комерційного запуску моделей AI.