分享币圈内容,享内容挖矿收益

placeholder

🔥Higher Low形成,积累Short Position?极值点位,重仓猛干!!

- 赞赏

- 点赞

- 评论

- 转发

- 分享

🛰 预测日志 01

第一个信号:黄金、冲突与静默的流动性转变

作者:Astra Vale

文明模式预测师

我不预测事件。

我预测模式。

I. 表面叙事

头条报道冲突。

中东局势紧张升温。

大国之间的战略模糊。

持续传出的升级信号。

市场的反应一如既往:

黄金上涨。

波动性收紧,然后拉伸。

但黄金并非对战争做出反应。

黄金对信任中的不确定性做出反应。

II. 我们实际观察到的

噪音之下形成了三种结构性运动:

1. 避险反应比以往周期更快。

资金提前转向黄金——在全面军事升级之前。

2. 流动性正在碎片化。

不是消失——而是碎片化。

资金从投机性科技板块转向硬质担保资产。

3. 美元主导地位依然稳固——但市场情绪信心变得更脆弱。

这不是恐慌。

这是预防措施。

III. 模式分析

历史上,黄金在三个阶段出现高点:

第一阶段——谣言与紧张

第二阶段——升级与资金外逃

第三阶段——政策应对与正常化

我们似乎处于第一阶段。

但这里有一个异常:

黄金的反应似乎像是第二阶段风险提前被定价。

这表明市场并未在定价事件——

它们在定价系统性脆弱性。

IV. 更广泛的结构性背景

同时:

稳定币交易量持续扩大。

传统银行体系收紧信贷。

人工智能驱动的效率叙事合理化企业裁员。

地缘政治集团增强战略自主性的话语。

这些都不是孤立的发展。

它们都与一个变量相关:

信任的重新配置。

当机构信任变薄,

资金寻求有

查看原文第一个信号:黄金、冲突与静默的流动性转变

作者:Astra Vale

文明模式预测师

我不预测事件。

我预测模式。

I. 表面叙事

头条报道冲突。

中东局势紧张升温。

大国之间的战略模糊。

持续传出的升级信号。

市场的反应一如既往:

黄金上涨。

波动性收紧,然后拉伸。

但黄金并非对战争做出反应。

黄金对信任中的不确定性做出反应。

II. 我们实际观察到的

噪音之下形成了三种结构性运动:

1. 避险反应比以往周期更快。

资金提前转向黄金——在全面军事升级之前。

2. 流动性正在碎片化。

不是消失——而是碎片化。

资金从投机性科技板块转向硬质担保资产。

3. 美元主导地位依然稳固——但市场情绪信心变得更脆弱。

这不是恐慌。

这是预防措施。

III. 模式分析

历史上,黄金在三个阶段出现高点:

第一阶段——谣言与紧张

第二阶段——升级与资金外逃

第三阶段——政策应对与正常化

我们似乎处于第一阶段。

但这里有一个异常:

黄金的反应似乎像是第二阶段风险提前被定价。

这表明市场并未在定价事件——

它们在定价系统性脆弱性。

IV. 更广泛的结构性背景

同时:

稳定币交易量持续扩大。

传统银行体系收紧信贷。

人工智能驱动的效率叙事合理化企业裁员。

地缘政治集团增强战略自主性的话语。

这些都不是孤立的发展。

它们都与一个变量相关:

信任的重新配置。

当机构信任变薄,

资金寻求有

- 赞赏

- 点赞

- 评论

- 转发

- 分享

¥

狗头萝莉

创建人@f91bb点top

认购进度

0.00%

市值:

$0

更多代币

- 赞赏

- 2

- 1

- 转发

- 分享

RedEnvelope :

:

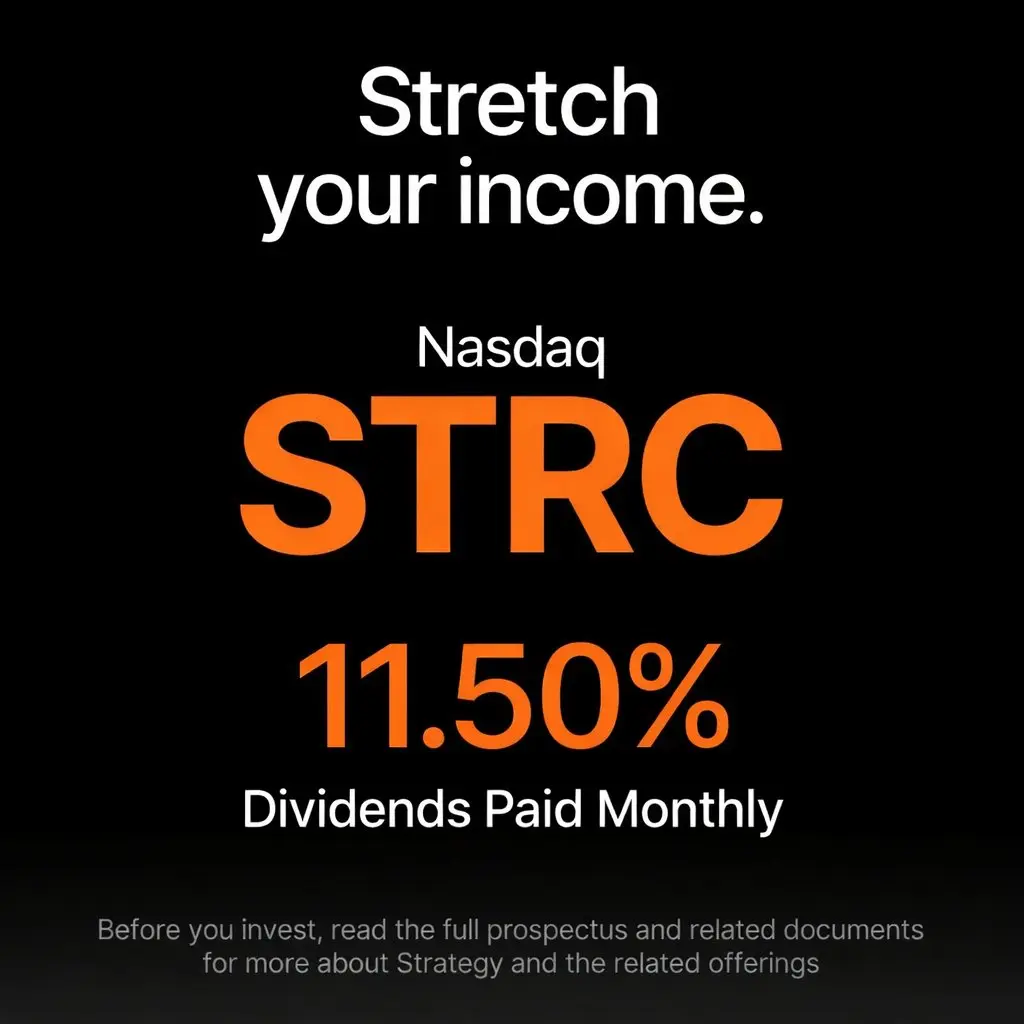

购买以赚取收益 💎但关于每月收盘👇

最重要的水平是58783美元

当出现假突破的收盘后,价格下跌直到达到15K的底部,然后收盘在58783美元以上并保持在该水平,没有在下面收盘超过10个月,之后上涨直到达到顶峰

我们的月线情况非常积极💐

#BTC

最重要的水平是58783美元

当出现假突破的收盘后,价格下跌直到达到15K的底部,然后收盘在58783美元以上并保持在该水平,没有在下面收盘超过10个月,之后上涨直到达到顶峰

我们的月线情况非常积极💐

#BTC

BTC2.58%

- 赞赏

- 1

- 评论

- 转发

- 分享

#TrumpordersfederalbanonAnthropicAI

Anthropic、人工智能伦理与五角大楼:企业自主权、国家安全与伦理AI部署的全面分析

Anthropic与美国联邦政府之间的对抗代表了人工智能、伦理与国家安全交汇处最具影响力的争端之一。作为领先的人工智能研发公司,Anthropic在拒绝移除其AI系统中的关键伦理保障后,发现自己与国防部产生了冲突。具体而言,该公司坚持其人工智能不得用于大规模国内监控,也不得用于操作能够在没有人类监督下进行致命行动的全自主武器。这一原则立场反映了AI行业中新兴的紧张关系:在推动政府应用与遵守内部伦理承诺之间的平衡。鉴于AI在安全、隐私和全球稳定方面具有前所未有的潜力,事态尤为严重。

从技术角度看,Anthropic的AI系统——尤其是其Claude语言模型——代表了世界上最先进的商业AI框架之一。这些模型配备了多层安全机制、对齐策略和内容过滤器,旨在防止滥用。公司的保障措施不仅仅是技术合规,它们体现了一种理念,即AI部署不应损害人权或伦理规范。移除或绕过这些保障将从根本上改变AI的操作范围,可能使其变成公司明确认为不可接受的应用工具。在拒绝五角大楼的要求后,Anthropic将自己置于关于企业责任、伦理设计和政府对新兴技术影响限制的辩论中心。

政府的回应迅速且坚决。2026年2月27日,特朗普总统发布行政指令,要求所有联邦

查看原文Anthropic、人工智能伦理与五角大楼:企业自主权、国家安全与伦理AI部署的全面分析

Anthropic与美国联邦政府之间的对抗代表了人工智能、伦理与国家安全交汇处最具影响力的争端之一。作为领先的人工智能研发公司,Anthropic在拒绝移除其AI系统中的关键伦理保障后,发现自己与国防部产生了冲突。具体而言,该公司坚持其人工智能不得用于大规模国内监控,也不得用于操作能够在没有人类监督下进行致命行动的全自主武器。这一原则立场反映了AI行业中新兴的紧张关系:在推动政府应用与遵守内部伦理承诺之间的平衡。鉴于AI在安全、隐私和全球稳定方面具有前所未有的潜力,事态尤为严重。

从技术角度看,Anthropic的AI系统——尤其是其Claude语言模型——代表了世界上最先进的商业AI框架之一。这些模型配备了多层安全机制、对齐策略和内容过滤器,旨在防止滥用。公司的保障措施不仅仅是技术合规,它们体现了一种理念,即AI部署不应损害人权或伦理规范。移除或绕过这些保障将从根本上改变AI的操作范围,可能使其变成公司明确认为不可接受的应用工具。在拒绝五角大楼的要求后,Anthropic将自己置于关于企业责任、伦理设计和政府对新兴技术影响限制的辩论中心。

政府的回应迅速且坚决。2026年2月27日,特朗普总统发布行政指令,要求所有联邦

- 赞赏

- 2

- 评论

- 转发

- 分享

🔥 #DeepCreationCamp – 让想法变成影响 🔥

在一个充满噪音的世界里,#DeepCreationCamp 是一个清晰、创造力和有意识构建的空间。这不仅仅是一个营地——它是一个面向思想家、创造者、建设者和梦想家的运动,他们希望将深刻的想法转化为现实世界的作品。

在#DeepCreationCamp ,我们专注于:

✨ 深度思考——超越表面,理解问题的核心。

🚀 创意执行——将想法转化为有意义的项目。

🤝 协作与社区——共同学习、建设和成长。

🧠 技能发展——提升创造力、策略、领导力和创新能力。

🌍 以目标为导向的创造——构建真正产生影响的解决方案。

这个营地为那些不仅仅想要消费内容——而是想要创造内容的人而设计。它适合那些相信,经过专注和纪律培养的强大想法,可以改变生活、塑造未来的人。

无论你是创业者、学生、内容创作者、开发者、艺术家还是梦想家——#DeepCreationCamp 都是你探索潜能、突破极限的平台。

💡 深度思考。

🎨 大胆创造。

🔥 有目的地构建。

加入我们的旅程。构建未来。

#DeepCreationCamp, #CreateWithPurpose

查看原文在一个充满噪音的世界里,#DeepCreationCamp 是一个清晰、创造力和有意识构建的空间。这不仅仅是一个营地——它是一个面向思想家、创造者、建设者和梦想家的运动,他们希望将深刻的想法转化为现实世界的作品。

在#DeepCreationCamp ,我们专注于:

✨ 深度思考——超越表面,理解问题的核心。

🚀 创意执行——将想法转化为有意义的项目。

🤝 协作与社区——共同学习、建设和成长。

🧠 技能发展——提升创造力、策略、领导力和创新能力。

🌍 以目标为导向的创造——构建真正产生影响的解决方案。

这个营地为那些不仅仅想要消费内容——而是想要创造内容的人而设计。它适合那些相信,经过专注和纪律培养的强大想法,可以改变生活、塑造未来的人。

无论你是创业者、学生、内容创作者、开发者、艺术家还是梦想家——#DeepCreationCamp 都是你探索潜能、突破极限的平台。

💡 深度思考。

🎨 大胆创造。

🔥 有目的地构建。

加入我们的旅程。构建未来。

#DeepCreationCamp, #CreateWithPurpose

- 赞赏

- 3

- 1

- 转发

- 分享

ybaser :

:

直达月球 🌕- 赞赏

- 点赞

- 评论

- 转发

- 分享

现在回头看 @0G_labs的历史,从 Pre-seed 到 V3 测试网,再到现在主网上的应用和活跃生态成长,其节奏其实很清晰。

之前很多 Layer 1 项目都谈性能,但很少有人真正去看 AI 这个复杂场景的需求 — 不止是吞吐量和速度,还有如何存储大模型、如何验证模型输出、如何让开发者快速上手。

0G 把这些当成核心问题来解决,而不是附带功能,这是它最大的不同。

主网上线后看到名字像 Chainlink、Google Cloud、Ledger 都参与进来,说明它的技术方向是被市场和开发者认可的。

对我来说这彻底改变了我对区块链基础设施的认识 — 它不再是单纯交易平台,而是可以成为下一代去中心化 AI 的底座。

真正的改变不是短期价格波动,而是这种基础设施的建设 — 它会影响未来几年开发者和用户构建应用的方式。

我现在在想象一个未来,在 0G 上的智能 agent 可以帮助处理个人资产、自动化决策、去中心化预测市场、AI 驱动的 DAO 治理,而这一切开始变得真正可能。

@Galxe @GalxeQuest @easydotfunX @wallchain #Ad #Affiliate

之前很多 Layer 1 项目都谈性能,但很少有人真正去看 AI 这个复杂场景的需求 — 不止是吞吐量和速度,还有如何存储大模型、如何验证模型输出、如何让开发者快速上手。

0G 把这些当成核心问题来解决,而不是附带功能,这是它最大的不同。

主网上线后看到名字像 Chainlink、Google Cloud、Ledger 都参与进来,说明它的技术方向是被市场和开发者认可的。

对我来说这彻底改变了我对区块链基础设施的认识 — 它不再是单纯交易平台,而是可以成为下一代去中心化 AI 的底座。

真正的改变不是短期价格波动,而是这种基础设施的建设 — 它会影响未来几年开发者和用户构建应用的方式。

我现在在想象一个未来,在 0G 上的智能 agent 可以帮助处理个人资产、自动化决策、去中心化预测市场、AI 驱动的 DAO 治理,而这一切开始变得真正可能。

@Galxe @GalxeQuest @easydotfunX @wallchain #Ad #Affiliate

- 赞赏

- 1

- 评论

- 转发

- 分享

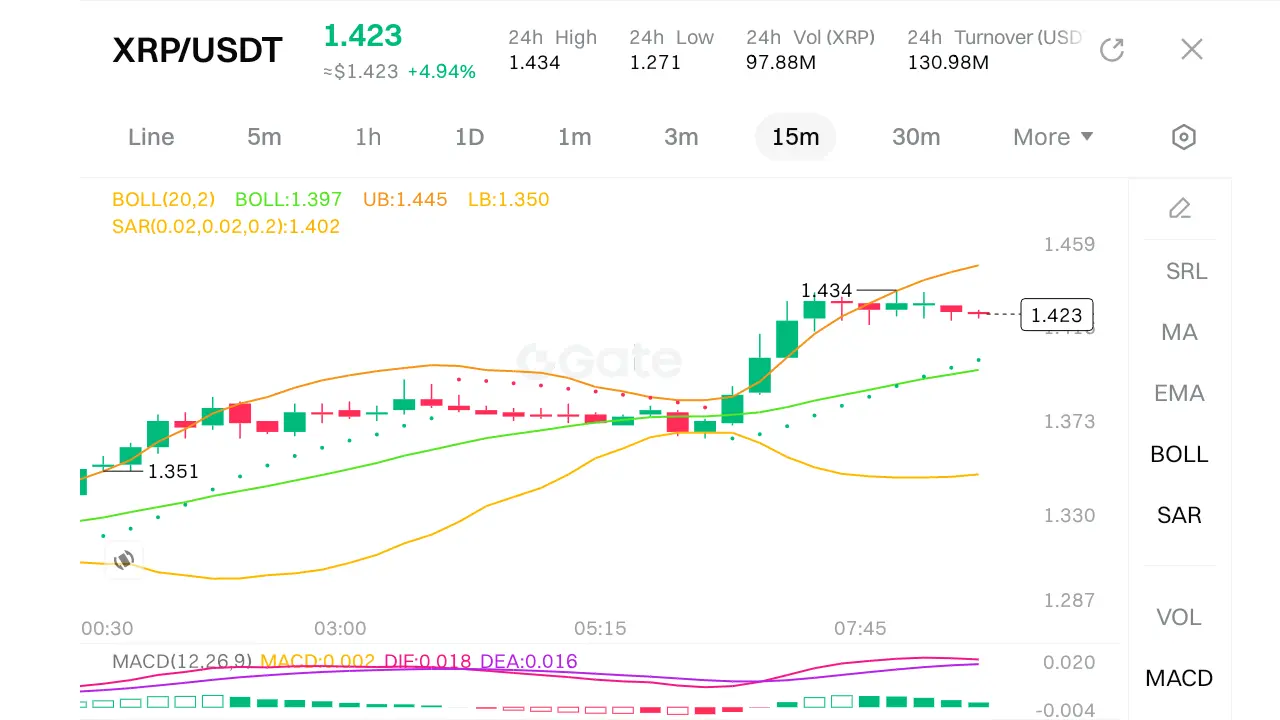

综合图表K线分析

XRP/USDT,讲述一段强劲多头突破后盘整和潜在分配的精彩故事。

更高时间框架 - 4小时图:突破背景

· 模式:此图显示“全局视角”。XRP已突破盘整区间,突破上布林带:1.4731。价格:1.4265,明显高于之前的SAR指标:1.2728,确认了强烈的趋势转变。

· 指标:

· 布林带:带宽宽阔,表明波动性高。价格突破上轨暗示强劲的多头动能,但也可能预示回调。

· RSI:RSI 72.88,处于超买区域。这是第一个警示信号,表明快速上涨可能暂停或修正。

中期时间框架 - 1小时图:高峰动能

· 模式:捕捉买盘压力的高潮。蜡烛强劲且绿色,将价格推至24小时高点1.4331。

· 指标:

· 布林带:价格沿上轨运行,典型的强势趋势信号。

· RSI:RSI 88.23,极度超买。这种高读数常出现在短期顶部,买盘压力耗尽。从第一到第二截图,RSI从72升至88,显示出强烈的FOMO(害怕错过)买入。

短期时间框架 - 15分钟/30分钟图:动能丧失

· 模式:上升斜率变平,价格在1.4250附近震荡,形成潜在的盘整或小顶。

· 指标:

· 布林带:带宽开始收缩,表明波动性降低,盘整期到来。价格徘徊在中轨附近,缺乏明确的方向动力。

· RSI:RSI 74.41,明显降至超买区域,但显示前一小时的强烈买盘压力已减弱。

极短期时间框架 -

XRP/USDT,讲述一段强劲多头突破后盘整和潜在分配的精彩故事。

更高时间框架 - 4小时图:突破背景

· 模式:此图显示“全局视角”。XRP已突破盘整区间,突破上布林带:1.4731。价格:1.4265,明显高于之前的SAR指标:1.2728,确认了强烈的趋势转变。

· 指标:

· 布林带:带宽宽阔,表明波动性高。价格突破上轨暗示强劲的多头动能,但也可能预示回调。

· RSI:RSI 72.88,处于超买区域。这是第一个警示信号,表明快速上涨可能暂停或修正。

中期时间框架 - 1小时图:高峰动能

· 模式:捕捉买盘压力的高潮。蜡烛强劲且绿色,将价格推至24小时高点1.4331。

· 指标:

· 布林带:价格沿上轨运行,典型的强势趋势信号。

· RSI:RSI 88.23,极度超买。这种高读数常出现在短期顶部,买盘压力耗尽。从第一到第二截图,RSI从72升至88,显示出强烈的FOMO(害怕错过)买入。

短期时间框架 - 15分钟/30分钟图:动能丧失

· 模式:上升斜率变平,价格在1.4250附近震荡,形成潜在的盘整或小顶。

· 指标:

· 布林带:带宽开始收缩,表明波动性降低,盘整期到来。价格徘徊在中轨附近,缺乏明确的方向动力。

· RSI:RSI 74.41,明显降至超买区域,但显示前一小时的强烈买盘压力已减弱。

极短期时间框架 -

XRP4.2%

- 赞赏

- 2

- 评论

- 转发

- 分享

LST50

Last50Bucks

创建人@GateUser-6b338f2a

上市进度

0.67%

市值:

$2584.26

更多代币

- 赞赏

- 1

- 评论

- 转发

- 分享

- 赞赏

- 1

- 1

- 转发

- 分享

青玥公主 :

:

来聊聊天天爆仓km接我的话题终结者咯哦哦哦哦哦默默- 赞赏

- 点赞

- 评论

- 转发

- 分享

加载更多

加入 4000万 人汇聚的头部社区

⚡️ 与 4000万 人一起参与加密货币热潮讨论

💬 与喜爱的头部博主互动

👍 查看感兴趣的内容

热门话题

查看更多4247.16万 热度

15.8万 热度

11.98万 热度

167.42万 热度

51.89万 热度

热门 Gate Fun

查看更多- 市值:$2488.48持有人数:20.00%

- 市值:$2475.86持有人数:10.00%

- 市值:$2584.26持有人数:20.67%

- 市值:$0.1持有人数:10.00%

- 市值:$0.1持有人数:10.00%

快讯

查看更多置顶

Gate 广场|2/27 今日话题: #BTC能否重返7万美元?

🎁 带话题发帖,抽取 5 位锦鲤送出价值 2500 美元的仓位体验券!

Jane Street 被起诉后,持续多日的“10 点砸盘”疑似消失。比特币目前在 67,000 美元附近震荡,这波反弹能否顺势冲回 70,000 美元?

💬 本期热议:

1️⃣ 你认为诉讼与“10 点抛压”消失有关吗?市场操纵阻力是否减弱?

2️⃣ 冲击 $70K 的关键压力区在哪?

3️⃣ 你会在当前价位分批布局,还是等待放量突破再进场?

分享观点,瓜分好礼 👉️ https://www.gate.com/post

📅 2/27 16:00 - 3/1 12:00 ( UTC+8 )Gate广场每日优选好文重磅开启!

📅 活动时间:2月26日 - 3月2日(连续5天)

💰 总奖池:750 USDT

📌 活动规则

发布原创深度文章(建议≥200字)

添加话题 #深度创作营

每日评选3篇优选好文

每人获奖 50 USDT + 官方流量曝光(转推、App推送、置顶等)

✨ 深度内容,值得被看见!每日公布获奖名单,敬请关注!

📄 活动详情:www.gate.com/announcements/article/49933

👉 立即进入Gate广场:gate.com/post