Qu'est-ce que le Q-Day : fondamentaux de l'informatique quantique, implications pour la cryptographie et transmission du risque pour la cryptomonnaie

Dans le cadre des échanges sur la sécurité financière et les registres distribués, le terme « Q‑Day » désigne généralement le moment où l’informatique quantique représente une menace pratique et concrète pour la cryptographie asymétrique largement utilisée — il ne s’agit pas d’un événement soudain à l’échelle de tout le réseau. Les analyses issues du secteur et du monde académique proposent des scénarios de référence, optimistes et pessimistes, selon des hypothèses différentes en matière d’échelle des qubits logiques, de ressources nécessaires pour les opérations de portes, de taux d’erreur physique et de constantes algorithmiques.

Définition et périmètre

Dans le débat public, Q‑Day est souvent confondu avec la « suprématie quantique » ou « l’avantage quantique », mais dans le domaine de la cryptographie, l’attention porte sur le CRQC : il ne s’agit pas seulement de réaliser des tâches d’échantillonnage spécialisées, mais bien de démontrer des vecteurs d’attaque évolutifs contre des structures comme RSA, les corps finis ou les logarithmes discrets sur courbe elliptique, dans des limites de coût et de temps définies. Trois frontières principales se dégagent :

- Temps : la majorité des indicateurs sont des intervalles ou des analyses de sensibilité, rarement une date calendaire précise.

- Cible : les menaces visent la combinaison de primitives cryptographiques, de choix de paramètres et d’implémentations système, et non un scénario linéaire du type « les ordinateurs quantiques migrent automatiquement les Actifs on-chain ».

- Information : de nombreux modèles exigent une surface d’attaque clairement définie — par exemple, la différence entre les matériaux de Clé publique exposés on-chain et les engagements ne révélant que des Hash, chacun ayant un niveau d’exploitabilité distinct.

Informatique quantique : notions fondamentales

Les qubits exploitent la superposition pour encoder des structures d’information complexes dans l’espace de Hilbert. L’intrication implique que les états multi-particules ne peuvent être réduits à des états individuels séparés, ce qui constitue la base de nombreux algorithmes quantiques. Les processeurs quantiques actuels sont limités par le bruit et la décohérence, ce qui impose l’utilisation de la correction d’erreurs quantiques pour approcher la fiabilité à long terme de l’informatique quantique tolérante aux fautes. Les discussions techniques portent donc sur des indicateurs tels que l’équivalence des qubits logiques, les seuils de tolérance aux fautes, le surcoût de correction d’erreurs, la fidélité des portes et les cycles de calibration.

Certains algorithmes quantiques offrent des avantages super-polynomiaux en termes de ressources par rapport à l’informatique classique pour des types de problèmes spécifiques. L’algorithme de Shor en est l’exemple le plus marquant, car il remet directement en cause la robustesse des clés publiques fondée sur des structures algébriques précises.

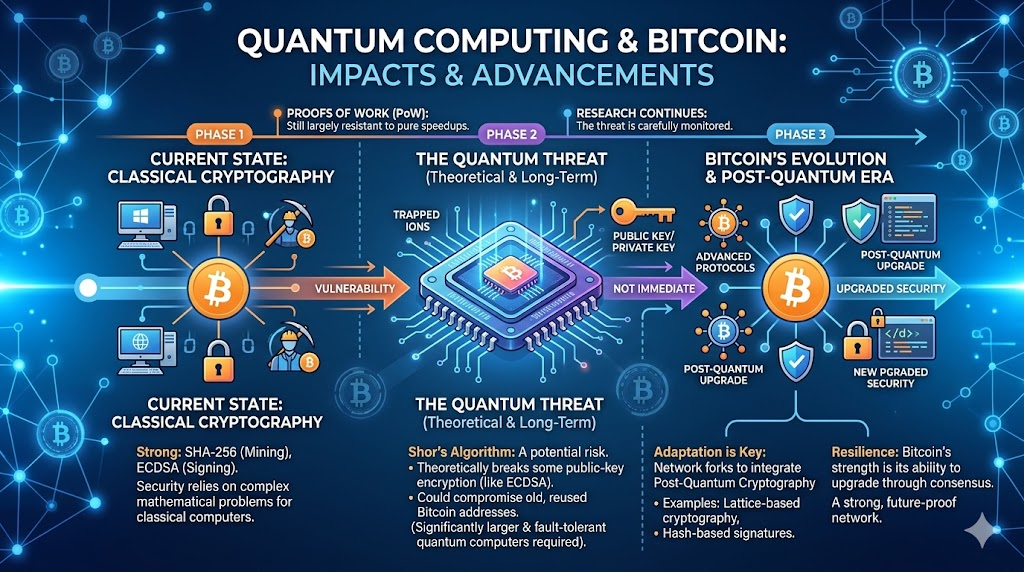

Algorithme de Shor et courbes utilisées par les cryptomonnaies

L’algorithme de Shor, présenté en 1994, permet de résoudre en temps polynomial les problèmes de factorisation d’entiers et de logarithmes discrets dans un contexte quantique. Les adresses blockchain courantes et les Signature reposent sur la difficulté des logarithmes discrets sur courbe elliptique — Bitcoin, par exemple, utilise des Signature basées sur secp256k1 (d’abord ECDSA, puis les schémas Schnorr).

Dans l’analyse des menaces, les données on-chain contenant des Clés publiques ou des Clés publiques reconstruites — combinées à une puissance de calcul quantique tolérante aux fautes suffisante — transforment l’axiome classique « les Clés privées ne peuvent être déduites des informations publiques » en une problématique de gestion du risque : l’attention se déplace vers la période de transition, le moment d’exposition de la clé et l’éventuelle apparition de nouvelles exigences interactives lors de la migration.

Facteurs structurels dans les écosystèmes de cryptomonnaies

Les registres ouverts imposent trois contraintes majeures, distinctes du PKI Web :

- Transparence historique : les Trade(s) passés peuvent être rejoués à l’infini, ce qui peut alimenter de futurs algorithmes.

- Voies de mise à niveau du consensus : la migration cryptographique dépend de changements de règles réseau et de l’adoption généralisée par les clients, un processus lent et complexe d’un point de vue théorique.

- Alignement économique et des incitations : les Mineurs/Validateur, Développeur de Wallet, entreprises et utilisateurs peuvent avoir des priorités et des échéances divergentes.

Les options de migration post-quantique on-chain incluent les Signature hybrides, les preuves ZK (zero-knowledge) ou de nouveaux opcodes permettant la vérification de Signature post-quantique. Pour les départager, il faut comparer le nombre de portes, l’échelle des qubits logiques, les projections de taux d’erreur, les coûts d’interaction on-chain et la compatibilité — au-delà des slogans théoriques.

En résumé : l’impact potentiel de l’informatique quantique sur la Blockchain

Un Portefeuille blockchain repose sur une « adresse publique et une clé privée ». En temps normal, connaître l’adresse de quelqu’un ne suffit pas — les Clés privées sont quasi impossibles à déduire. Avec l’informatique quantique avancée, casser certains algorithmes de Signature traditionnels pourrait devenir beaucoup plus simple, permettant à des attaquants de forger des Signature en un temps réduit. Pour les blockchains, le véritable enjeu n’est pas seulement « la technologie peut-elle être compromise », mais « combien de temps faudra-t-il pour que l’ensemble du réseau se mette à niveau » : protocoles, Wallets, exchanges et Dépositaire doivent tous adopter des solutions post-quantiques. Plus la transition est lente, plus la période de risque est longue pour les Actifs dont les Clés publiques sont déjà exposées.

Comment interpréter les informations et recherches publiques en 2026

La feuille de route 2026 du Project Eleven, The Quantum Threat to Blockchains 2026, fixe la référence Q‑Day autour de 2033, avec des scénarios optimistes et pessimistes (souvent cités comme 2030 et 2042 ; il convient toujours de se référer aux sources originales). Cette publication estime que les blockchains utilisant massivement les Signature sur courbe elliptique devront être repensées en profondeur, et que le débat doit rester évolutif : de nouveaux benchmarks matériels et de nouvelles recherches doivent permettre d’ajuster les scénarios sans s’arrêter à une date unique.

Les publications sur des plateformes telles que Cryptology ePrint Archive proposent régulièrement des estimations actualisées des ressources nécessaires pour les modèles de menace sur courbe elliptique. Les conclusions varient selon les paramètres du modèle : il est donc essentiel de vérifier la longueur de clé cible, les méthodes de tolérance aux fautes, les stratégies de parallélisation et les constantes pour garantir leur pertinence pour la chaîne étudiée.

Stratégies de réponse dans l’écosystème

Les réponses techniques courantes incluent le déploiement pilote des algorithmes post-quantiques du NIST en entreprise, la réduction de la durée de vie des certificats et des clés, et le suivi des propositions techniques de migration de chaînes spécifiques. Pour les utilisateurs finaux, les points de contrôle essentiels sont :

- Le réseau cible dispose-t-il d’une feuille de route de migration PQ (post-quantique) et d’un plan de compatibilité ?

- Les Wallets sont-ils mis à jour en cohérence avec la couche de consensus et les correctifs de sécurité ?

- Les politiques de rotation des clés et d’évolution des algorithmes dans les processus de conservation ou de Multi-signature sont-elles vérifiables ?

Les risques liés à la cryptographie et la volatilité du marché secondaire relèvent de cadres d’analyse distincts ; cet article se concentre uniquement sur les structures conceptuelles et la typologie de l’information.

Articles Connexes

Comment Midnight assure-t-il la confidentialité sur la blockchain ? Analyse des preuves à divulgation nulle de connaissance et des mécanismes de confidentialité programmables

Plasma (XPL) face aux systèmes de paiement traditionnels : une nouvelle approche du règlement transfrontalier et du cadre de liquidité pour les stablecoins

La relation entre Midnight et Cardano : comment une sidechain axée sur la confidentialité élargit l’écosystème applicatif de Cardano

Morpho vs Aave : analyse des différences de mécanisme et de structure entre les protocoles de prêt DeFi

Qu'est-ce qui constitue l'écosystème Solana (SOL) ? Analyse de ses cas d'utilisation et de sa structure d'infrastructure