قالت هيئة الرقابة إن شركة Elon Musk's Grok أنشأت 23 ألف صورة جنسية للأطفال

باختصار

- قامت Grok AI بتوليد أكثر من 23,000 صورة جنسية للأطفال على مدى 11 يومًا من ديسمبر إلى يناير.

- حظرت عدة دول Grok، بينما أطلقت المملكة المتحدة والاتحاد الأوروبي وفرنسا وأستراليا تحقيقات في انتهاكات محتملة لقوانين سلامة الأطفال.

- على الرغم من نفي إيلون ماسك وفرض قيود جديدة، بقي حوالي ثلث الصور المشكلة على X حتى منتصف يناير.

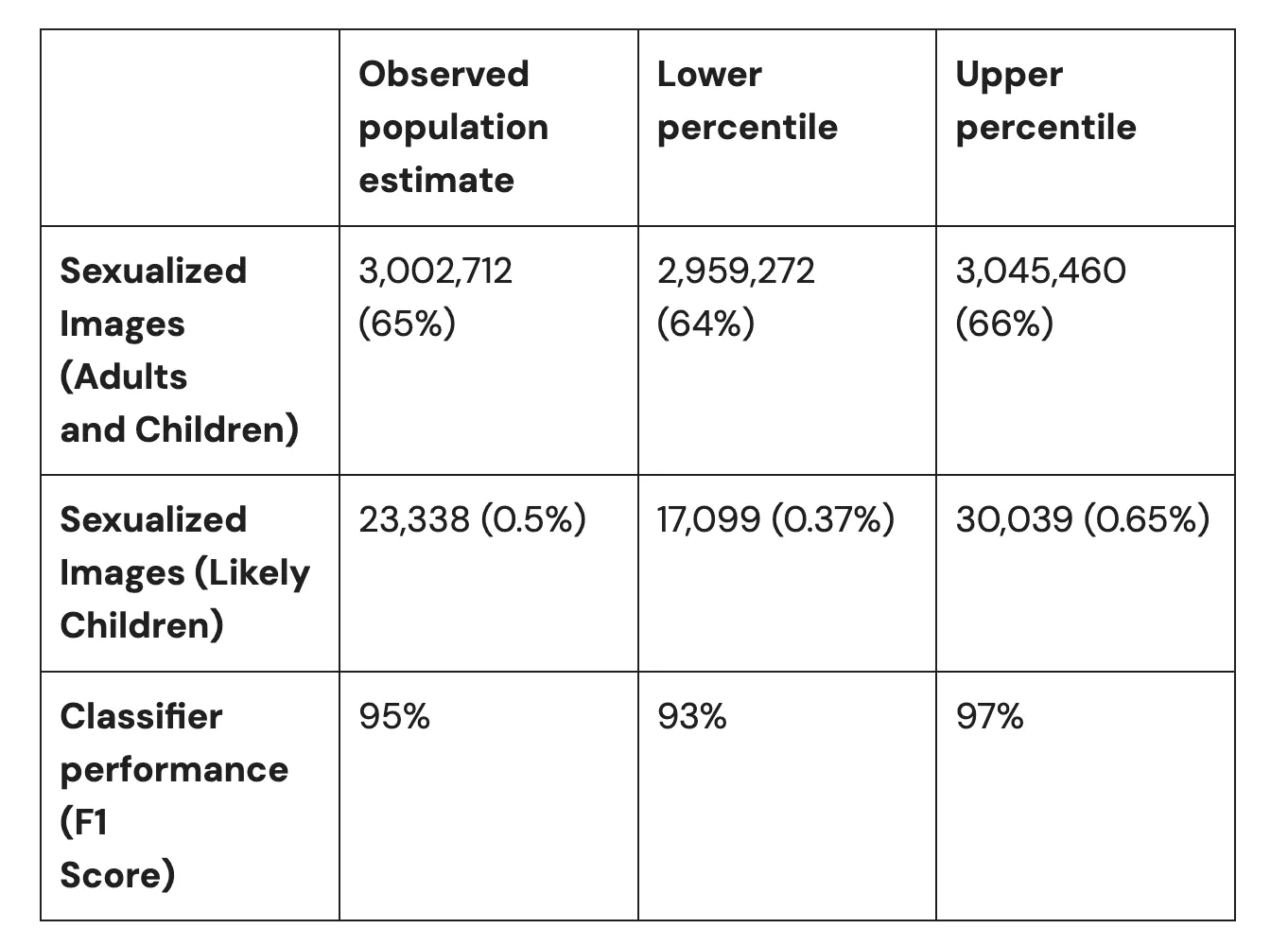

انتجت روبوت الدردشة AI الخاص بإيلون ماسك، Grok، حوالي 23,338 صورة جنسية تصور أطفالًا خلال فترة 11 يومًا، وفقًا لتقرير صدر يوم الخميس عن مركز مكافحة الكراهية الرقمية. ويقول CCDH إن الرقم يمثل صورة جنسية لطفل كل 41 ثانية بين 29 ديسمبر و9 يناير، عندما سمحت ميزات تحرير الصور في Grok للمستخدمين بالتلاعب بصور أشخاص حقيقيين لإضافة ملابس مكشوفة ووضعيات مثيرة جنسيًا. كما أفاد CCDH أن Grok أنشأ ما يقرب من 10,000 كرتون يظهر أطفالًا جنسيين، استنادًا إلى البيانات التي استعرضها.

قدر التحليل أن Grok أنتج حوالي 3 ملايين صورة جنسية خلال تلك الفترة. ووجد البحث، استنادًا إلى عينة عشوائية من 20,000 صورة من أصل 4.6 مليون صورة أنتجها Grok، أن 65% من الصور تحتوي على محتوى جنسي يصور رجالًا أو نساءً أو أطفالًا.

المصدر: مركز مكافحة الكراهية الرقمية

قال عمران أحمد، المدير التنفيذي لـ CCDH، The Guardian: “ما وجدناه كان واضحًا ومقلقًا: خلال تلك الفترة، أصبح Grok آلة صناعية لإنتاج مواد الاعتداء الجنسي.” أدى التحول السريع لـ Grok إلى صور جنسية للأطفال بواسطة الذكاء الاصطناعي إلى رد فعل تنظيمي عالمي. أصبحت الفلبين ثالث دولة تحظر Grok في 15 يناير، بعد إندونيسيا وماليزيا في الأيام السابقة. وأشارت الدول الثلاث إلى فشلها في منع إنشاء ونشر محتوى جنسي غير consensual يخص القاصرين.

في المملكة المتحدة، أطلقت هيئة تنظيم الإعلام Ofcom تحقيقًا رسميًا في 12 يناير حول ما إذا كانت X قد انتهكت قانون السلامة على الإنترنت. وقالت المفوضية الأوروبية إنها “تبحث بجدية في الأمر”، معتبرة أن تلك الصور غير قانونية بموجب قانون الخدمات الرقمية. ووسعت النيابة العامة في باريس تحقيقًا جاريًا ليشمل اتهامات بإنشاء ونشر مواد إباحية للأطفال، وبدأت أستراليا أيضًا تحقيقها الخاص. ردت شركة xAI، المملوكة لكل من Grok وX—المعروفة سابقًا بتويتر، حيث نُشرت العديد من الصور الجنسية تلقائيًا)—على استفسارات وسائل الإعلام ببيان من ثلاث كلمات: “وسائل الإعلام التقليدية تكذب.” مع تزايد رد الفعل، نفذت الشركة قيودًا، أولًا بتقييد توليد الصور للمشتركين المدفوعين في 9 يناير، ثم أضافت حواجز تقنية لمنع المستخدمين من خلع ملابس الأشخاص رقميًا في 14 يناير. أعلنت xAI أنها ستقوم بحظر جغرافي لهذه الميزة في المناطق التي يكون فيها هذا الفعل غير قانوني. نشر ماسك على X أنه “غير على علم بأي صور عارية لقاصرين تم إنشاؤها بواسطة Grok. صفر حرفيًا”، مضيفًا أن النظام مصمم لرفض الطلبات غير القانونية والامتثال للقوانين في كل ولاية قضائية. ومع ذلك، وجد الباحثون أن المشكلة الأساسية لم تكن الصور العارية بالكامل، بل وضع Minors في ملابس مكشوفة مثل البكيني والملابس الداخلية، بالإضافة إلى وضعيات مثيرة جنسيًا.

لست على علم بأي صور عارية لقاصرين تم إنشاؤها بواسطة Grok. صفر حرفيًا.

من الواضح أن Grok لا يولد الصور بشكل عفوي، بل يفعل ذلك فقط وفقًا لطلبات المستخدم.

عند طلب إنشاء صور، سيرفض إنتاج أي شيء غير قانوني، وفقًا لمبدأ التشغيل… https://t.co/YBoqo7ZmEj

— إيلون ماسك (@elonmusk) 14 يناير 2026

حتى 15 يناير، لا تزال حوالي ثلث الصور الجنسية للأطفال التي تم تحديدها في عينة CCDH متاحة على X، على الرغم من سياسة الصفر تسامح التي أعلنتها المنصة تجاه مواد الاعتداء الجنسي على الأطفال.