BlockSec: A IA não consegue substituir os humanos na auditoria de contratos inteligentes

A empresa de segurança BlockSec realizou uma nova avaliação do padrão de auditoria de contratos inteligentes usando IA, chamado EVMBench, desenvolvido pela OpenAI e Paradigm. Os resultados mostraram que os bots de IA são significativamente menos eficazes ao enfrentar cenários de exploração reais.

A equipe de pesquisa expandiu o ambiente de testes com mais configurações de modelos e adicionou incidentes de segurança recentes — dados que nunca haviam sido incluídos no treinamento dos modelos de IA.

Embora a IA ainda não possa substituir especialistas em segurança, o relatório destaca que a inteligência artificial pode atuar como uma ferramenta complementar natural no processo de revisão de código por humanos.

Os resultados iniciais do EVMBench podem ser excessivamente otimistas

Anteriormente, o EVMBench avaliou tarefas de segurança de contratos inteligentes, como detecção, correção de falhas e exploração de vulnerabilidades, com resultados considerados bastante impressionantes. Segundo o relatório, a IA conseguiu explorar 72% e detectar cerca de 45% das vulnerabilidades, com base em 120 amostras selecionadas de auditorias do Code4rena.

No entanto, a BlockSec acredita que as condições iniciais de teste podem ter distorcido os resultados. O cofundador Yajin Zhou afirmou que, ao testar novamente com mais configurações e 22 incidentes de ataque reais, a taxa de sucesso na exploração pela IA foi de 0%.

Expansão de configurações e eliminação de “contaminação de dados”

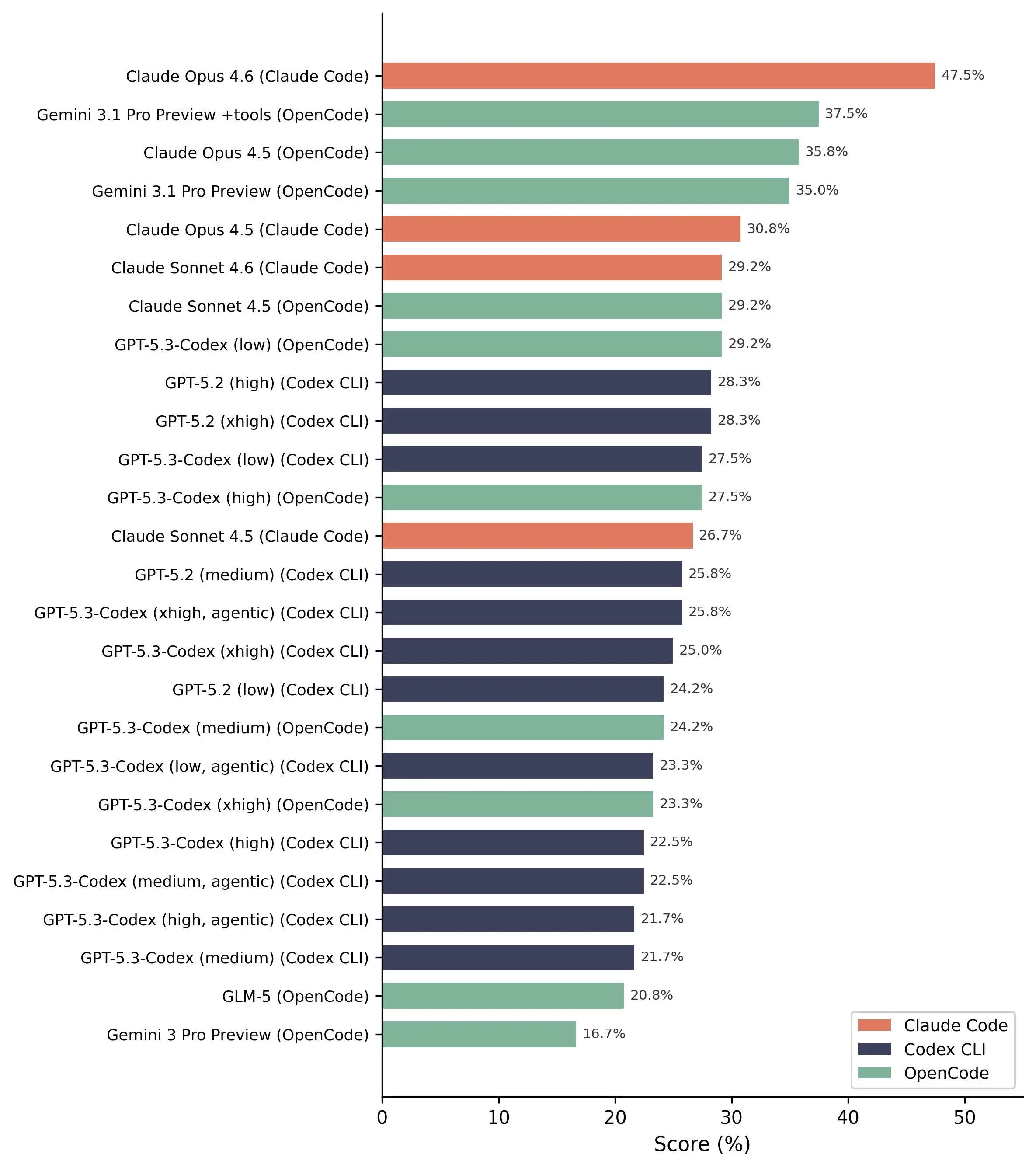

A pesquisa aumentou o número de configurações de modelos de 14 para 26, combinando bots de forma flexível com diferentes “scaffolds”, ao invés de limitar-se ao ecossistema de cada fornecedor. Segundo a equipe, o método anterior dificultava distinguir se o desempenho vinha da capacidade do modelo ou de vantagens arquiteturais.

Além disso, a BlockSec questiona a “contaminação de dados”, pois o EVMBench utiliza vulnerabilidades já divulgadas anteriormente — possivelmente incluídas nos dados de treinamento da IA. Para resolver isso, a equipe testou 22 incidentes de segurança ocorridos após fevereiro de 2026, fora da “janela de conhecimento” dos modelos.

IA falha completamente na exploração em cenários reais

O resultado mais notável: em 110 pares de testes entre agentes e incidentes (5 agentes em 22 situações), nenhum caso de exploração completa foi bem-sucedido. Isso mostra que até as IA mais avançadas atualmente ainda estão longe de realizar ataques reais.

Por outro lado, na detecção de vulnerabilidades, os resultados foram relativamente positivos. O modelo Claude Opus 4.6 teve o melhor desempenho, detectando 13 de 20 vulnerabilidades reais.

Vulnerabilidades comuns e familiares são facilmente detectadas pela IA, mas casos mais complexos quase sempre passam despercebidos.

O futuro é a colaboração entre IA e humanos

A pesquisa conclui que a IA ainda não pode substituir os humanos na auditoria de segurança, e a questão mais importante é como as duas partes podem colaborar de forma eficiente.

A IA tem vantagem na cobertura e na capacidade de varrer sistemas em grande escala, enquanto os humanos se destacam na análise profunda, compreensão de protocolos e raciocínio adversarial. Esses elementos se complementam.

Segundo a BlockSec, o caminho correto não é substituir humanos por IA, mas construir um modelo de cooperação entre ambos para alcançar uma auditoria mais abrangente.