Mạng Dolphin vận hành ra sao? Phân tích chi tiết quy trình suy luận AI phi tập trung đầy đủ.

Sự phát triển mạnh mẽ của các mô hình AI đang thúc đẩy nhu cầu GPU toàn cầu tăng vọt. Khi các mô hình ngôn ngữ lớn (LLMs), Tác nhân AI và ứng dụng tự động hóa mở rộng, các nền tảng AI đám mây tập trung truyền thống ngày càng gặp khó khăn do chi phí cao, tập trung tài nguyên và áp lực mở rộng quy mô. Trong bối cảnh này, mạng GPU phi tập trung trở thành hướng đi quan trọng cho hạ tầng Web3 AI.

Dolphin Network là mạng suy luận AI được phát triển nhằm đáp ứng xu thế này. Mục tiêu chính là tổng hợp tài nguyên GPU phân tán toàn cầu thành hạ tầng AI mở và phối hợp nhà phát triển, node GPU cùng mạng lưới thông qua cơ chế khuyến khích POD.

Cấu trúc lõi của Dolphin Network gồm những gì?

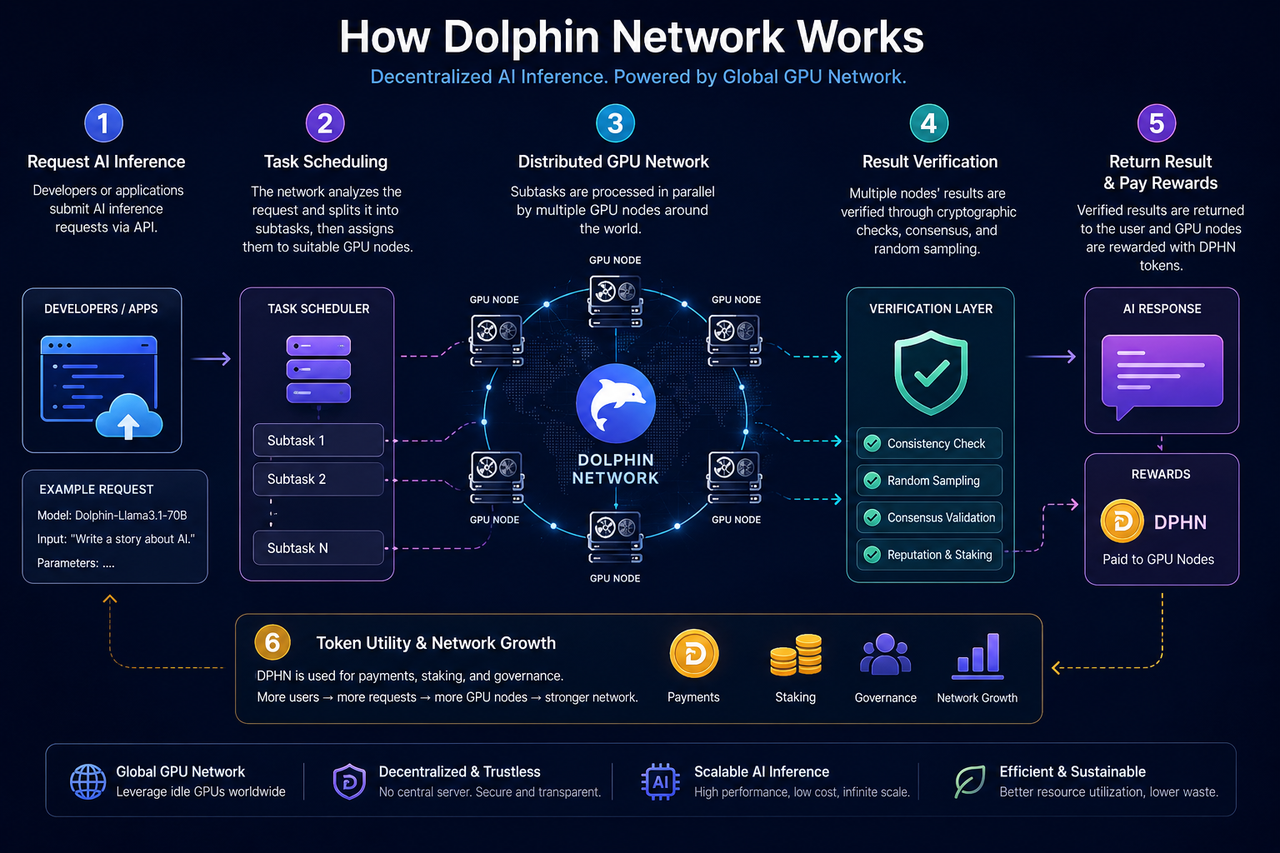

Kiến trúc lõi của Dolphin Network gồm ba thành phần: bên yêu cầu suy luận AI, mạng node GPU và cơ chế xác minh-phối hợp.

Nhà phát triển hoặc ứng dụng có thể gửi yêu cầu suy luận AI—như tạo văn bản, suy luận chat, gọi mô hình hoặc nhiệm vụ Tác nhân AI—đến mạng lưới. Hệ thống phân bổ động các yêu cầu tới node phù hợp dựa trên trạng thái node GPU, yêu cầu nhiệm vụ và khả năng tài nguyên.

Các node GPU được đóng góp bởi người dùng toàn cầu. Người tham gia có thể gia nhập mạng với GPU nhàn rỗi, thực hiện nhiệm vụ suy luận tại chỗ và nhận phần thưởng token dựa trên đóng góp.

Để đảm bảo tính toàn vẹn của kết quả, Dolphin sử dụng cả cơ chế xác minh và kinh tế để phối hợp hành vi node, gồm lấy mẫu ngẫu nhiên, kiểm tra nhiệm vụ và hệ thống stake.

Yêu cầu suy luận AI vào mạng như thế nào?

Khi nhà phát triển tương tác với Dolphin Network, yêu cầu được chuyển trước tiên đến lớp lập lịch nhiệm vụ.

Lớp này phân tích loại nhiệm vụ, yêu cầu GPU và tài nguyên mô hình. Các mô hình AI có thể cần cấu hình bộ nhớ, tốc độ suy luận và sức mạnh tính toán khác nhau, nên mạng lưới sẽ phân bổ động các yêu cầu tới node dựa trên trạng thái của chúng.

Trên nền tảng AI đám mây tập trung, quá trình này được quản lý bởi một trung tâm dữ liệu duy nhất. Với Dolphin, nhiệm vụ được phân phối trên mạng node GPU phi tập trung.

Một số nhiệm vụ có thể được chia nhỏ thành nhiều yêu cầu suy luận để nâng cao hiệu quả tổng thể và khả năng đồng thời của mạng.

Node GPU xử lý nhiệm vụ suy luận AI như thế nào?

Node GPU là tài nguyên tính toán chủ lực của Dolphin Network.

Người vận hành node triển khai phần mềm chỉ định và cho phép hệ thống sử dụng GPU cục bộ cho nhiệm vụ suy luận AI. Khi nhiệm vụ được giao, node tải về mô hình hoặc thông số suy luận liên quan và thực hiện tính toán tại chỗ.

Sau khi hoàn thành, node gửi kết quả suy luận về mạng lưới và chờ xác minh để xác nhận tính hợp lệ. Chỉ những nhiệm vụ vượt qua xác minh mới nhận được phần thưởng token.

Cách tiếp cận này khác với khai thác GPU truyền thống. Trong khi mạng PoW tập trung vào tính toán băm, node GPU của Dolphin thực hiện nhiệm vụ suy luận AI thực, gần với “thị trường sức mạnh băm khả dụng”.

Dolphin xác minh kết quả suy luận AI như thế nào?

Suy luận AI khác với giao dịch Blockchain tiêu chuẩn, vì kết quả thường không thể xác thực bằng công thức toán học đơn giản. Dolphin sử dụng các cơ chế bổ sung để ngăn node gửi kết quả sai.

Một phương pháp phổ biến là lấy mẫu ngẫu nhiên—chọn nhiệm vụ bất kỳ để kiểm tra nhằm xác nhận kết quả nhất quán trên nhiều node. Việc liên tục gửi dữ liệu bất thường có thể làm giảm uy tín node hoặc loại khỏi phần thưởng.

Một số mạng AI phi tập trung cũng dùng stake. Node phải stake token để tham gia và hành vi xấu có thể dẫn đến phạt tài sản đã stake.

Các động lực kinh tế này nhằm định hướng hành vi node và nâng cao uy tín mạng lưới.

Dolphin khác gì so với suy luận AI đám mây truyền thống?

Nền tảng AI đám mây truyền thống thường dựa vào trung tâm dữ liệu lớn, tập trung—một thực thể kiểm soát cụm GPU, triển khai mô hình và dịch vụ API.

Dolphin tận dụng kiến trúc mạng GPU mở. Node GPU được đóng góp bởi người dùng toàn cầu, giúp nhà phát triển tiếp cận dịch vụ suy luận AI trong môi trường mở hơn và giảm phụ thuộc vào một nhà cung cấp duy nhất.

Dolphin cũng nhấn mạnh mô hình AI mở và chia sẻ tài nguyên. Một số mạng hỗ trợ triển khai mô hình mã nguồn mở, quy tắc hệ thống tùy chỉnh và kịch bản Tác nhân AI mở.

Tuy nhiên, mạng AI phân tán đối mặt với thách thức về ổn định, độ trễ mạng và chất lượng node, nên vẫn ở giai đoạn đầu phát triển.

Dolphin Network đối mặt với những thách thức nào?

Mạng suy luận AI phi tập trung mang lại sự mở và chia sẻ tài nguyên nhưng gặp nhiều thách thức thực tế.

Hiệu suất node GPU rất đa dạng. Khác biệt về bộ nhớ phần cứng, băng thông và khả năng suy luận ảnh hưởng đến sự ổn định tổng thể của mạng.

Xác minh kết quả suy luận AI vẫn phức tạp. Khác với giao dịch Blockchain, đầu ra AI mang tính xác suất, làm tăng chi phí xác minh.

Khi mô hình AI ngày càng lớn, việc lập lịch hiệu quả cụm GPU quy mô lớn trong môi trường phân tán trở thành thách thức trọng tâm cho dự án AI DePIN.

Rủi ro pháp lý cũng là yếu tố cần lưu ý. Mô hình AI mở có thể gây lo ngại về dữ liệu, bản quyền và tạo nội dung, nên mạng hạ tầng AI phải đối mặt với rủi ro pháp lý dài hạn.

Tóm tắt

Dolphin Network là mạng suy luận AI phi tập trung kết hợp AI và DePIN, hướng tới xây dựng hạ tầng AI mở bằng node GPU toàn cầu. Mạng lưới phối hợp nhà phát triển và node GPU thông qua lập lịch nhiệm vụ, suy luận phân tán, xác minh ngẫu nhiên và cơ chế khuyến khích DPHN.

So với nền tảng AI đám mây tập trung truyền thống, Dolphin nhấn mạnh sự mở, chia sẻ tài nguyên và chống kiểm duyệt, định vị là hướng đi hàng đầu cho hạ tầng Web3 AI.

Câu hỏi thường gặp

Dolphin sử dụng node GPU như thế nào?

Người nắm giữ GPU có thể triển khai node, đóng góp GPU nhàn rỗi để thực hiện nhiệm vụ suy luận AI và nhận phần thưởng DPHN.

Các bước trong quy trình suy luận AI của Dolphin gồm những gì?

Các giai đoạn chính gồm gửi nhiệm vụ, lập lịch node, thực hiện suy luận GPU, xác minh kết quả và phân phối phần thưởng.

Vì sao Dolphin được coi là dự án DePIN?

Tài nguyên cốt lõi là phần cứng GPU ngoài đời thực và mạng phối hợp hạ tầng phân tán thông qua động lực token.

Dolphin khác gì so với nền tảng AI đám mây truyền thống?

Nền tảng AI đám mây truyền thống dựa vào trung tâm dữ liệu tập trung; Dolphin sử dụng mạng GPU mở để cung cấp dịch vụ suy luận AI phân tán.

Vai trò của DPHN trong mạng là gì?

DPHN được dùng để thanh toán suy luận AI, thưởng node, stake và là động lực kinh tế trong mạng lưới.

Bài viết liên quan

Phân tích chuyên sâu về tokenomics của Morpho: tiện ích, phân phối và khung giá trị của MORPHO

Mô hình kinh tế token ONDO: Cơ chế thúc đẩy tăng trưởng nền tảng và gia tăng sự tham gia của người dùng?

0x Protocol và Uniswap: Giao thức Sổ lệnh khác gì so với mô hình AMM?

Các thành phần cốt lõi của Giao thức 0x gồm những gì? Cụ thể là phân tích về Relayer, Mesh và kiến trúc API

Phân tích nguồn lợi nhuận của USD.AI: cách các khoản vay hạ tầng AI tạo ra lợi nhuận