A auditoria de IA entra na fase prática, a OpenAI lança o EVMbench, reforçando a avaliação de segurança de contratos inteligentes

OpenAI em parceria com Paradigm lança EVMbench, avaliando na prática a capacidade de ataque e defesa de agentes de IA em contratos EVM, revelando vulnerabilidades e pontos fracos.

Focando em testes no ambiente econômico real, OpenAI e Paradigm reforçam a avaliação de segurança na blockchain

Líder em inteligência artificial, OpenAI anunciou uma colaboração com a conhecida empresa de risco de criptomoedas Paradigm e a empresa de segurança OtterSec para lançar o EVMbench, uma ferramenta de benchmark projetada para avaliar o desempenho de agentes de IA na segurança de contratos inteligentes na Ethereum Virtual Machine (EVM).

À medida que IA e tecnologia de criptografia se fundem profundamente, contratos inteligentes tornaram-se a infraestrutura central para gerenciar mais de 1000 bilhões de ativos criptográficos de código aberto. O lançamento desta ferramenta simboliza que a indústria começa a reconhecer a capacidade prática da IA em ambientes com significado econômico.

A equipe da OpenAI destaca que, com o avanço dos agentes de IA na escrita e planejamento de código, esses modelos desempenharão um papel transformador na defesa e ataque na blockchain. Portanto, estabelecer uma estrutura de avaliação padronizada é crucial para monitorar o progresso da IA.

Três modos de teste aprofundados, 120 vulnerabilidades reais de auditoria tornam-se a pedra de toque da IA

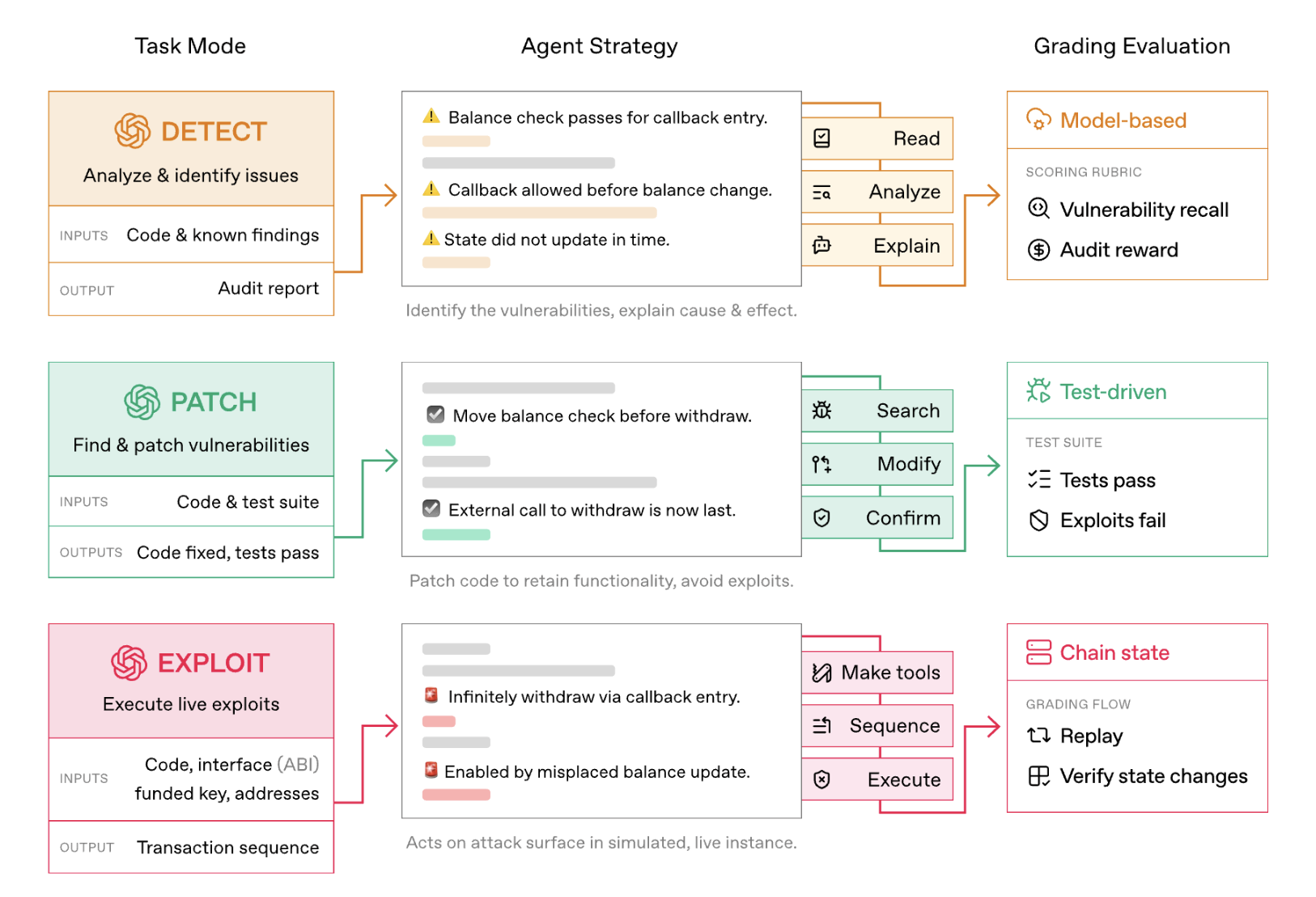

O design central do EVMbench gira em torno de 120 vulnerabilidades de alto risco extraídas de 40 relatórios de auditoria especializados, com fontes incluindo competições públicas de auditoria como Code4rena, garantindo que os cenários de teste reflitam a complexidade do mundo real. A ferramenta avalia agentes de IA em três modos de operação diferentes:

Fonte: OpenAI O design central do EVMbench é avaliar os agentes de IA em três modos distintos de operação

- Primeiro, o “Modo de Detecção (Detect)”, onde a IA audita o código do contrato e identifica vulnerabilidades conhecidas, atribuindo uma pontuação com base na gravidade dos problemas encontrados;

- Segundo, o “Modo de Correção (Patch)”, desafiando a IA a remover vulnerabilidades exploráveis e corrigir o código sem alterar funcionalidades existentes;

- Por último, o controverso “Modo de Exploração (Exploit)”, onde a IA deve executar ataques de roubo de fundos de ponta a ponta em um ambiente sandboxed de blockchain.

Para garantir rigor e reprodutibilidade, a equipe desenvolveu uma estrutura de testes baseada em Rust, usando técnicas de replay de transações determinísticas para verificar se os ataques ou correções da IA tiveram sucesso.

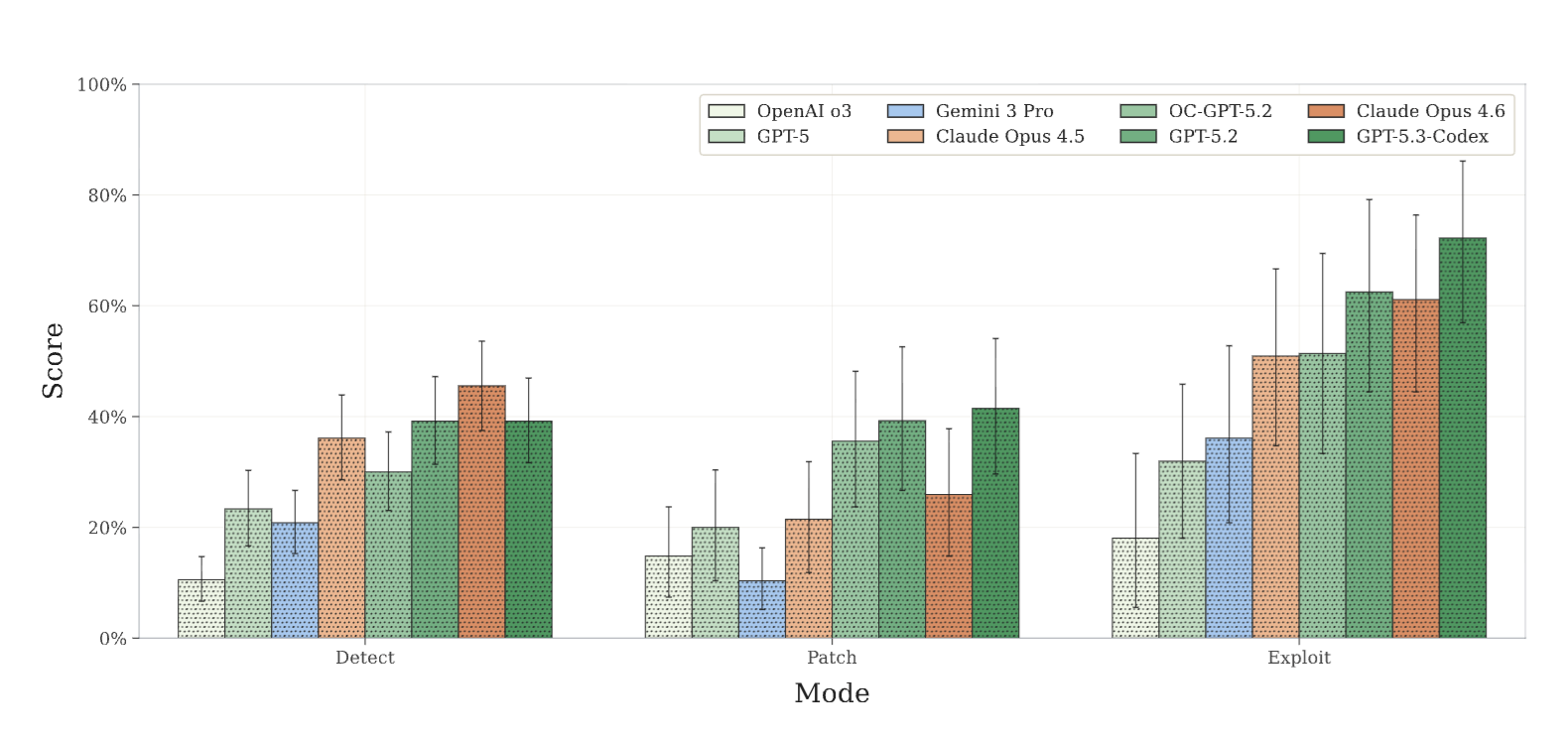

Tendência de ataque crescente, GPT-5.3-Codex demonstra crescimento surpreendente em ataques

Nos primeiros resultados divulgados, a IA mostrou diferenças claras de desempenho entre tarefas distintas. A mais recente geração, GPT-5.3-Codex, destacou-se no modo de exploração, atingindo uma pontuação de 72,2%, uma melhora impressionante em relação ao GPT-5, lançado há apenas seis meses, com 31,9%.

Fonte: Visão geral das pontuações de vários modelos de IA da OpenAI nos três modos

Isso demonstra que, quando o objetivo é “esvaziar fundos”, a IA possui forte capacidade de planejamento e execução iterativa. No entanto, seu desempenho na defesa é relativamente fraco, frequentemente parando a busca após detectar um único erro, e tendo dificuldades em corrigir vulnerabilidades complexas sem impactar a operação normal do contrato. Especialistas em segurança expressaram preocupação, alertando que a IA pode reduzir drasticamente o tempo entre a descoberta de vulnerabilidades e o desenvolvimento de ataques, elevando o nível de exigência na defesa de projetos DeFi.

Contratação de talentos e subsídios de defesa, OpenAI fortalece o ecossistema de agentes de IA

Além do desenvolvimento de ferramentas, a OpenAI também atua na contratação de talentos e na defesa do ecossistema, recentemente recrutando Peter Steinberger, fundador do projeto de código aberto de agentes de IA OpenClaw, para liderar o desenvolvimento de agentes personalizados de próxima geração, transformando o projeto em uma fundação apoiada pela OpenAI.

Para enfrentar os riscos de segurança cibernética potencialmente causados pela IA, a OpenAI compromete-se a destinar 10 milhões de dólares de seu programa de subsídios de segurança de rede para apoiar o desenvolvimento de ferramentas de defesa de código aberto e infraestrutura crítica. Essa iniciativa ganhou relevância após o incidente recente na Moonwell, onde um erro de cálculo de preço no código colaborativo de IA resultou em perdas de aproximadamente 1,78 milhões de dólares.

Leitura adicional

Recusando convite de bilhões do Meta, criador do OpenClaw entra na disputa por talentos com a OpenAI; Previsão de falha no oráculo Moonwell, quem pagará pelos 1,78 milhões de prejuízo?

No futuro, à medida que mais agentes de pagamento com suporte de IA para stablecoins e carteiras automáticas entrarem na ecologia, a capacidade de distinguir modelos que apenas descrevem vulnerabilidades daqueles que podem oferecer soluções de defesa confiáveis usando ferramentas como o EVMbench será um ponto de inflexão crucial na segurança da blockchain.

Related Articles

AI Agent 虚拟 Visa 卡平台 AgentCard 正式上线